UAV의 촬영각도 조절을 통한 3D 모델 구축에 관한 연구

A Study on 3D Model Construction by Controlling Unmanned Aerial Vehicle of Camera Angle

Article information

Abstract

본 연구에서는 UAV의 카메라 각도를 조절하여 항공사진을 촬영하고 2D 모델과 3D 모델을 구축하여 정량적인 영향을 평가하였다. 대상지역은 대구광역시 달성군에 위치한 와룡대교를 선정하였으며 UAV의 카메라 각도는 90°, 75°, 60°에 대하여 촬영하여 DSM과 정사영상, 3차원 모델을 분석하였다. DSM과 정사영상의 분석결과 Images의 중첩도는 90°대비 75°는 1.05배, 60°는 1.10배이며 Matching의 중첩도는 90° 대비 75°는 1.09배, 60°는 1.60배가 증가하였다. 3D 모델을 구축하기 위한 포인트 클라우드는 90°대비 75°가 1.17배, 60°는 1.47배로 분석 포인트가 증가하였다. 그러나, 1 pixel의 정사영상 면적은 90°대비 75°가 1.10배, 60°는 1.34배 증가하여 해상도는 감소하였다. UAV의 카메라 각도가 감소할수록 항공사진의 중첩부분이 증가하여 많은 면적의 구조물을 구현할 수 있다. 그러나, 3D 모델의 정밀도에서는 큰 차이가 발생하므로 목적에 따른 촬영계획이 수립되어야 한다.

Trans Abstract

In this study, the camera angle of a UAV (Unmanned Aerial Vehicle) was adjusted to take aerial photographs, and 2D and 3D models were constructed to evaluate the quantitative impact. The study area was Waryong Bridge, located in Dalseong-gun, Daegu Metropolitan City. The camera angles of the UAV were 90°, 75°, and 60°; DSM, orthophoto, and the 3D model were analyzed. As a result of the analysis of DSM and orthophoto, images were 1.05 times in 75° and 1.10 times in 60° compared to 90°, and matching was 1.09 times in 75° and 1.60 times in 60° compared to 90°. The point cloud for building 3D models increased analysis points to 1.17 times for 75° and 1.47 times for 60° compared to 90°. However, the area of an orthophoto of 1 pixel increased by 1.10 times for 75° and 1.34 times for 60° compared to 90°, resulting in a decrease in resolution. As the camera angle of the UAV decreases, the overlapping ratio of aerial photographs increases and the structure of wide areas can be implemented. However, since a large difference occurs in the precision of the 3D model, a shooting plan according to the purpose should be established.

1. 서 론

4차 산업혁명 이후 드론을 활용한 다양한 사업이 국내외에서 활용되고 있다. 과거 위성사진과 항공사진의 분석은 지형구축이나 모니터링 등에 활용되었으나 화질에 따른 정확도의 문제로 정성적인 영향만이 평가에 한정되었다. 최근 UAV의 발명과 다양한 영상분석 센서의 탑재로 정밀한 항공사진의 분석이 가능하여 많은 분야에서 UAV의 활용성이 확장되고 있다. UAV를 이용한 항공사진의 촬영은 카메라의 화질개선을 통한 정확도가 증가되어 지형정보와 구조물 구축 등에 활용되고 있다. 최근 다양한 프로그램의 개발로 촬영된 항공사진을 2D 모델 또는 3D로 모델을 구축하면서 구조물, 재난, 건설현장에서 사용되고 있다. 최근 무인 비행기(Unmanned Aerial Vehicle, UAV)를 활용하기 위한 다양한 연구가 수행되고 있다.

국내외의 UAV로 수행된 연구내용은 Digital Surface Model (DSM), 정사영상 등을 분석하여 정확도를 평가하거나 적용성에 대하여 제안하였다. UAV를 이용하여 대상지역의 항공사진을 촬영하여 DEM을 생성하고 정사영상 또는 사진이미지와 비교하여 정확도를 분석하였다(Feurer et al., 2008; Sauerbier and Eisenbeiss, 2010; Lee et al., 2012; Lee, 2015; Lee et al., 2015; Ruzgiene et al., 2015; Uysal et al., 2015; Park et al., 2016; Bang et al., 2018). 또한, 소프트웨어를 활용하여 대량의 항공사진을 분석하여 DEM과 DSM을 구축하고 지형측량과 비교하여 정확도의 결과를 비교하였다(Choi et al., 2015; Rhee et al., 2015; Lee et al., 2016; Lee and Choi, 2016; Coveney and Roberts, 2017). 항공사진 촬영과 고행상도 영상을 기반으로 해안지역의 지형 모니터링, 지형의 변화 모니터링 그리고 지형의 체적산정 등의 UAV의 활용성도 제안되었다(Goncalves and Henriques, 2015; Pérez-Alberti and Trenhaile, 2015; Yu et al., 2016; Son et al., 2017). UAV를 활용한 항공사진의 촬영은 카메라 각도가 대부분 90°에 대한 정사영상이 대부분 활용되고 있다. 구조물에는 다양한 각도를 조정하여 촬영하라고 제시되었을 뿐 카메라 각도에 대한 정확도 평가는 수행되지 않았다.

UAV로 촬영된 항공사진을 분석하여 정량적인 오차율을 제안하거나 정확도를 보정하는 방법의 연구도 수행되었다. UAV의 영상을 DSM과 3D 모델로 구축할 때 기준점을 보정하지 않았을 때의 오차율이나 해상도의 적정성이 제안되었으나 다른 연구에서는 지상기준점의 필요성이 제시되었다(Udin and Ahmad, 2014; Rhee el al., 2015; Mesas- Carrascosa et al., 2016; Agüera-Vega et al., 2017; Kim et al., 2018; Kim and Yoon, 2018; Park and Um, 2018). 지상 기준점을 고려한 비선형 방법을 개발하여 실좌표 영상으로 변화하는 방법도 제안되었다(Noh et al., 2011). UAV로 촬영한 항공사진을 기반으로 구축된 자료의 정확도를 비교하였으나 다양한 카메라 각도를 고려한 정량적인 정확도 분석은 연구되지 않았다.

따라서, 본 연구에서는 대구광역시에 위치한 와룡대교를 대상으로 UAV의 카메라 각도를 조절하여 DSM과 정사영상, 3D 모델을 구축하고자 한다. 카메라 각도는 90°, 75°, 60°에 대하여 UAV촬영을 수행하였으며 고도, 비행방법, 중첩도, 면적은 동일한 조건을 적용하였다. 카메라 각도에 따른 2D 모델과 3D 모델에 분석영상의 정량적인 영향을 분석하고자 한다.

2. 연구방법

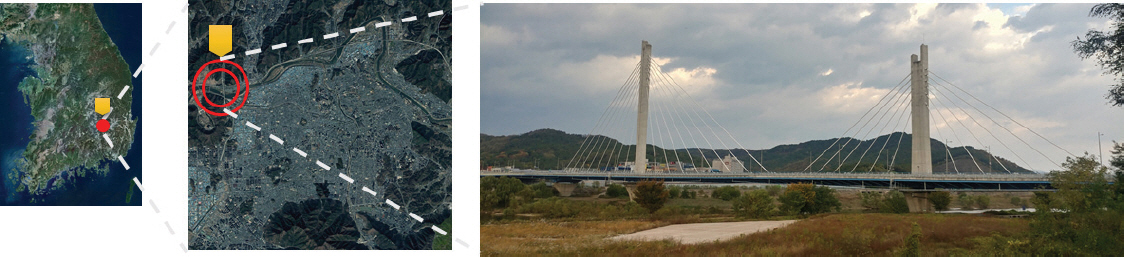

2.1 대상지역

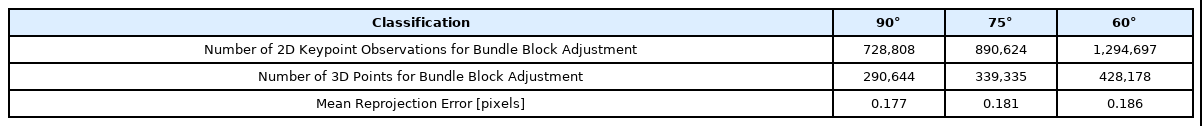

본 연구의 대상지역은 대구광역시를 통과하는 금호강의 북구와 서구를 이어주는 와룡대교로서 대구광역시 달성군 다사읍 방천리에 Fig. 1과 같이 위치하고 있다. 대구광역시는 대구국제공항이 위치하고 있어 대구광역시의 중구, 남구, 북구는 대부분 비행금지역이며 본 연구의 대상지역은 국토교통부의 비행신청 없이 운영 가능한 지역을 선정하였다.

본 연구의 대상지역인 와룡대교는 대구광역시 최초의 사장교로서 다른 교량과 달리 주탑에 케이블을 연결하여 교량에 가해지는 하중을 주탑과 케이블에 전달하는 형식이다. 와룡대교의 교량길이는 477 m, 교량폭은 32.3 m이며 상부형식은 사장교, 하부형식은 역 T형식 대교로 건설되었다(Table 1). 교량의 제원은 유효폭 25.5 m, 교량의 높이 24.0 m, 교량의 경간수 5개, 최대경간수 164 m로 2010년에 준공되었다.

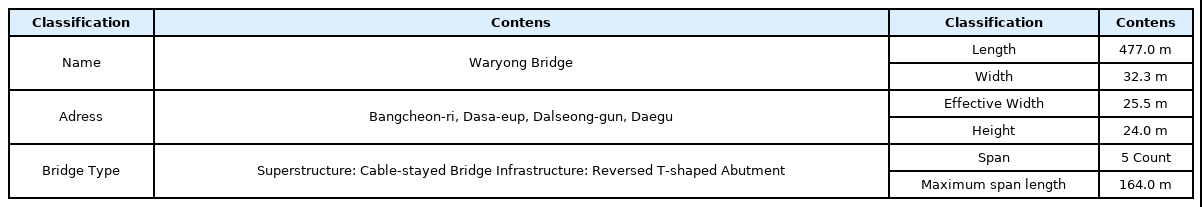

2.2 항공사진 촬영을 위한 관측장비 제원

항공사진 촬영에 활용된 UAV는 카메라의 화질과 안전성의 차이는 있지만 대부분의 UAV이 항공사진의 촬영이 가능하다. 그러나, 지형자료, 건축물, 기반시설 등의 정밀한 측량을 위해서는 전문 지도제작용의 특수장비가 필요하다. 그리고 정확한 좌표와 항공사진의 촬영에서 발생되는 오차를 줄이기 위한 보정장치들이 적용된 모델을 사용해야 한다. 본 연구에서는 자동비행을 통한 항공사진 촬영과 지형관측지점의 설정이 가능한 DJI사의 Phantom 4 RTK와 D-RKT 2 GNSS를 활용하였다(Fig. 2).

항공사진을 촬영하고 정확도를 확보하기 위해서는 지상 기준점인 Ground Control Point (GCP)의 자료를 활용해야 한다. 그러나, 본 연구에서는 Phantom 4 RTK의 지형자료 수신기능이 있는 기종을 활용하였으며 GPS 기반 자료를 획득할 수 있는 DJI사의 D-RTK 2 GNSS와 연동하여 지형자료의 정확도를 확보하였다. 항공사진의 촬영을 위한 UAV, 카메라, 지형측량장치에 대한 제원은 Table 2와 같다.

3. UAV를 활용한 데이터 구축

3.1 UAV의 촬영을 위한 비행계획 수립

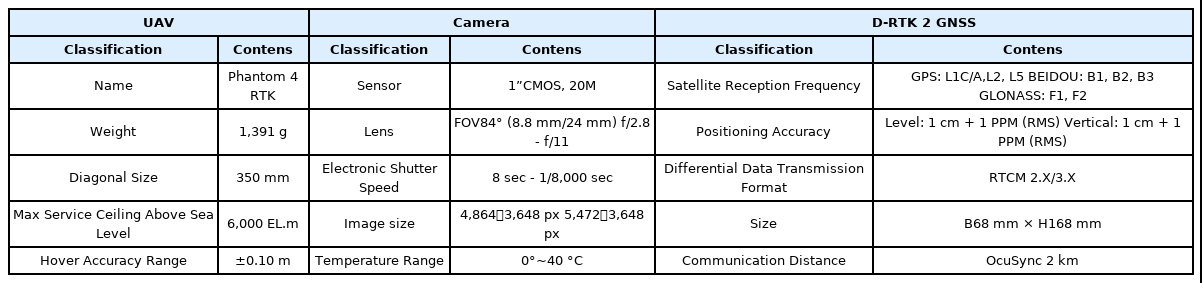

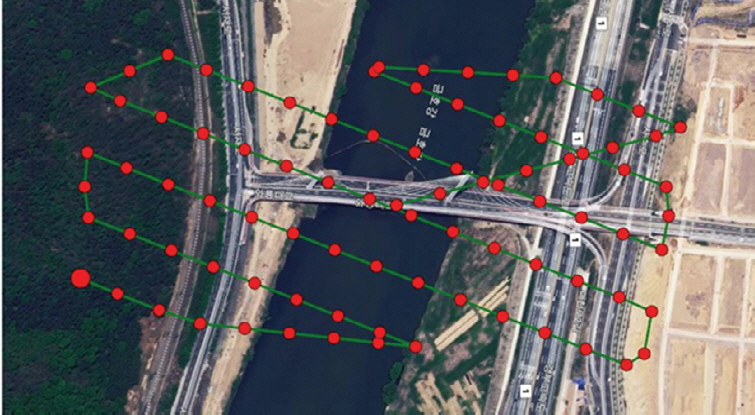

본 연구에서는 UAV의 카메라 각도를 고려한 3D 모델 구축에 따른 정량적인 영향을 분석하고자 한다. 카메라 각도를 제외한 촬영의 중첩도, 촬영고도, 촬영면적은 동일한 조건을 설정해야 한다. UAV 촬영시 기상학적 영향인 바람, 온도, 구름 등의 오류를 저감하기 위해 카메라의 각도별로 3회의 촬영을 수행하였다. UAV의 카메라 각도는 관측하는 시점의 변화로서 일반적으로 평지의 영상을 촬영하기에는 90°의 각도로도 대상지역의 정사영상을 구현할 수 있다. 그러나, 구조물의 경우 다양한 각도에서 촬영하여야 왜곡 없이 다양한 방향에서 사진을 기반으로 3D 모델의 구축이 가능하다. 본 연구에서는 연구대상지역의 비행계획은 와룡대교를 모두 관측할 수 있는 비행면적을 설정하였으며 UAV의 촬영각도별 GRID For 2D maps 모델을 통해 86 images를 촬영하는 것을 계획하였다(Fig. 3).

와룡대교의 UAV의 촬영을 위한 비행계획으로는 카메라 각도는 90°, 75°, 60°로 3조건, 촬영 횟수는 3회, 비행면적에 대한 중첩도는 GRID for 2D maps에서 종방향과 횡방향을 80%로 설정하였다. 촬영고도의 설정은 와룡대교 교탑의 높이 25.5 m를 포함하고 교탑 상단부까지 촬영이 가능한 고도는 120 m로 설정하였다. UAV의 촬영고도와 촬영의 중첩도를 고려한 결과 연구대상지역의 면적은 0.455 ㎢로 설정되었다. UAV의 촬영을 위한 비행계획의 조건은 Table 3과 같다.

3.2 UAV의 촬영각도를 고려한 DSM 구축

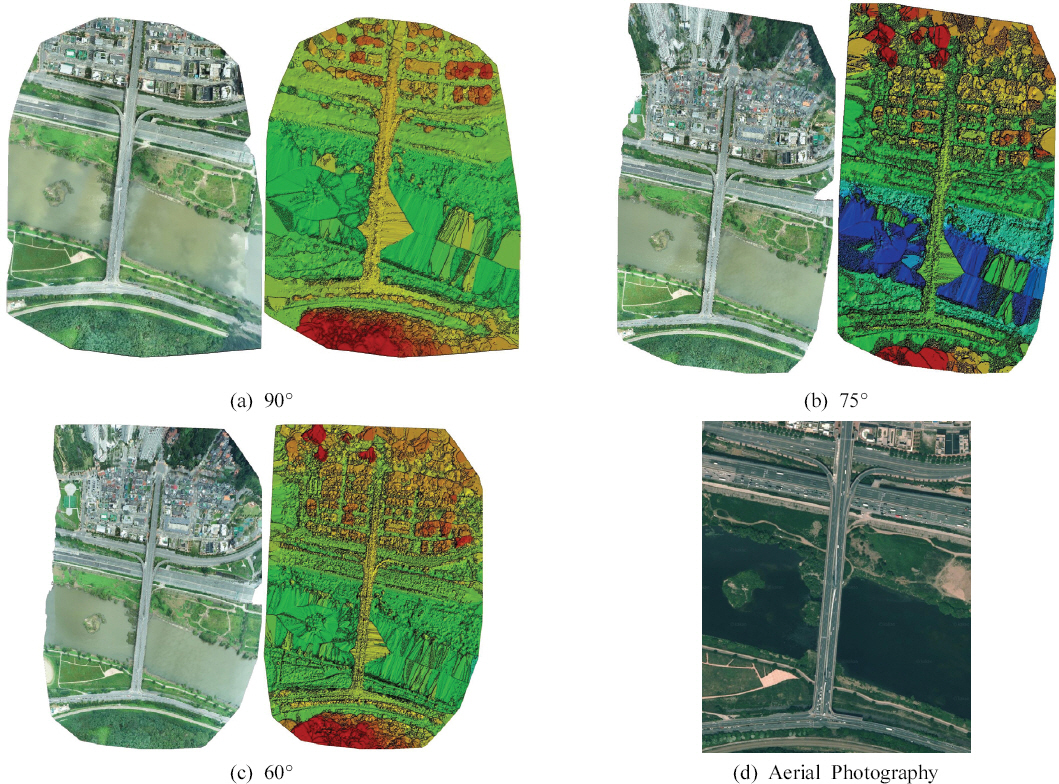

본 연구에서는 UAV로 촬영한 항공사진의 영상처리를 위해서 Pix4D Mapper를 이용하였으며 촬영지표자료를 활용한 DSM과 정사영상을 분석하였다. 정사영상은 총 4단계의 과정을 통해 항공촬영 사진들의 중복지역을 매칭점을 결정하고 포인트 클라우드를 생성하고 TIN을 생성하고 DSM과 정사영상을 제작하였다(Francesco et al., 2013). UAV의 좌표정보는 중부원점 기준의 TM 좌표계로 설정하였으며 D-RTK 2 GNSS의 좌표자료를 수신하여 지상기준점을 설정하였다. UAV의 카메라 각도의 90°, 75°, 60°에 대한 정사영상과 DSM결과는 Fig. 4와 같이 분석되었다.

UAV의 촬영 각도에 대하여 항공사진과 지상기준점을 이용하여 DSM과 정사영상에 대한 품질 특성을 분석하였다(Table 4). 촬영데이터의 품질은 UAV의 촬영각도에 따라 Images의 개수는 90°일 때 41,885개, 75°일 때 43,975개, 60°일 때 46,285개로서 촬영각도가 15°의 감소할수록 Images는 약 1.05배씩 증가하였다. 각 Images별 Matching 개수도 90°일 때 8,488.08개, 75°일 때 9,2393.49개, 60°일 때 13,584.00개로서 촬영각도가 15°의 감소할수록 Matching 개수는 90°에서 75°는 1.09배, 75°에서 60°는 1.60배 증가하였다. UAV의 촬영 각도에 대한 기상기준점의 RMSE는 촬영 결과물의 품질을 나타내는 지표로서 GNSS의 좌표자료와 UAV의 측량좌표와의 정확도 차이를 제시해주는 지표로서 카메라 각도별 오차는 90°는 0.0019 m, 75°는 0.0018 m, 60°는 0.0022 m가 발생하여 촬영한 데이터의 정확도를 확보하였다.

UAV의 카메라 각도별 Images를 구성하고 Matching된 항공사진은 각도가 감소할수록 증가하였으며 Table 5와 같이 세부특성이 분석되었다. 카메라 각도에 따라 UAV로 촬영된 항공사진을 하나의 정사영상으로 구성하였을 때 각도가 감소할수록 중복되는 영상의 정보가 최소, 최대, 평균 모두 증가하였다. 카메라 각도에 따른 영상의 화각이 넓어지기 때문에 사진측량에서 동일한 중첩도에도 불구하고 더 많은 영상정보가 확보되어 분석되었다.

4. 수리구조물의 3D 모델 적용성 평가

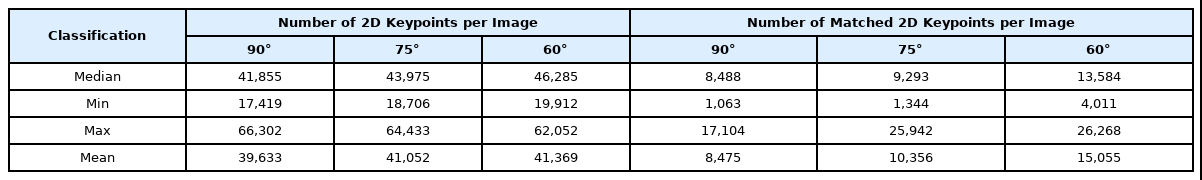

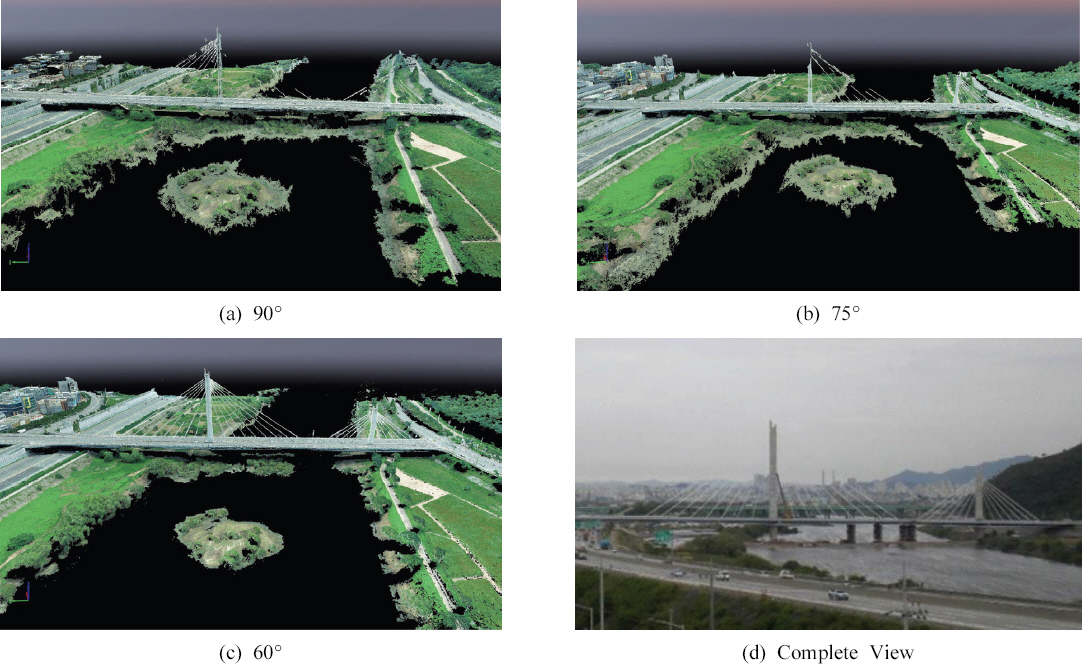

4.1 3D 모델 구축 및 데이터 분석

대상지역의 카메라 각도를 조절하여 UAV로 항공사진을 촬영하고 DSM과 정사영상을 분석하여 와룡대교의 3D 모델을 구축하였다. 카메라의 각도별 와룡대교의 3D 모델은 가시적인 결과부터 분석결과에 따른 정량적인 영향까지 다양한 방법으로 분석을 하였다. Pix4D에서 구축된 3D 모델의 교량은 카메라 각도별 가시적인 결과에서도 차이가 발생하였다(Fig. 5). 카메라의 각도가 90°에서는 교탑에 연결된 와이어가 왼쪽과 오른쪽 모두 3D 모델로 구성되지 못하였으며 교량 차도에서도 라인작업이 선명하게 구축되지 않았다. 카메라 각도가 75°에서는 90°보다는 교탑을 중심으로 와이어는 비슷하게 구성되었으나 교량 차도부분이 보다 선명하게 구축되었다. 카메라 각도 60°에서는 교탑의 와이어를 확인할 수 있으며 교량 차도부분도 라인이 선명하게 구축된 것을 확인할 수 있었다. 물론 UAV를 이용한 항공사진 촬영으로 교량의 하단부 교각부분은 모든 카메라 각도에서 모델이 구축되지 않았다.

와룡대교의 3D 모델은 관측된 항공사진으로 구축된 DSM과 정사영상이 활용되며 2D 모델에서 관측된 자료의 표고정보를 추가하여 3D 모델의 포인트를 분석한다(Table 6). 분석된 3D 모델의 포인트를 결합하여 프로그램에서 와룡대교를 구축하게 된다. 카메라 각도별 와룡대교의 2D 격자의 분석 수는 90°를 기준으로 75°가 1.22배, 60°는 1.78배로 2D 모델 구축을 위한 관측자료가 증가하였다. 또한 3D 모델 포인트의 경우도 카메가 각도가 감소할수록 90°를 기준으로 75°가 1.17배, 60°는 1.47배로 분석 포인트가 증가하였다. 그러나, 카메라 각도가 감소할수록 3D 모델 구축에 따른 1 pixels당 오류는 90°를 기준으로 75°가 1.02배, 60°는 1.05배로 큰 차이는 발생하지 않았다. 따라서, 항공사진을 이용한 3차원 모델 구축을 위해서는 정사영상이나 2D 포인트를 많이 확보할 수 있게 카메라 각도를 조절하여 많은 정보를 확보한다면 정밀한 자료를 구축할 수 있는 것으로 분석되었다.

4.2 촬영각도를 고려한 수리구조물 모델의 정확도 평가

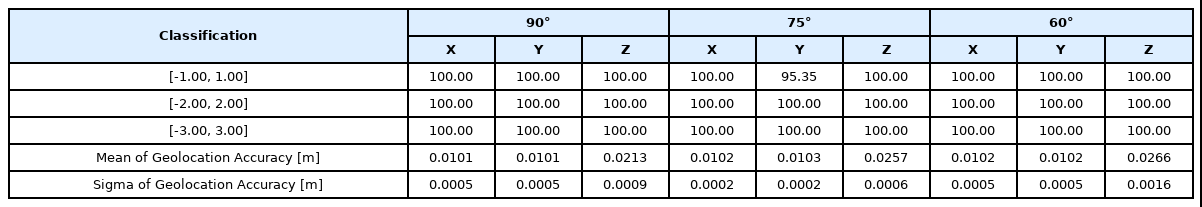

본 연구에서는 지상기준점의 위치정보 수집이 가능한 UAV를 활용하여 다양한 카메라 각도로 와룡대료를 촬영하였으며 X방향, Y방향, Z방향에 대한 지리위치의 정확도를 분석하였다(Table 7). 분석된 X방향, Y방향, Z방향의 카메라 각도에 대한 지리위치의 오차는 95.35%~100%로 95.35% 이상의 위치정보가 분석되어 허용 오차내로 정확도 높은 이미지가 촬영되었다. 지리위치의 평균 정확도는 카메라 각도별로 90°가 0.0415 m, 75°가 0.0462 m, 60°가 0.470 m로 카메라 각도별 0.5 cm 미만의 오차가 발생하였다. 지리위치에 대한 분산은 모든 카메라 각도에서 1.0 cm 미만이 발생하였으며 카메라 각도가 가장 작은 60°에서 가장 높은 분산이 분석되었다. 지리위치에 대한 카메라 각도의 정확도는 X방향, Y방향보다는 Z방향에서 대부분의 오차가 발생한 것으로 확인되었다.

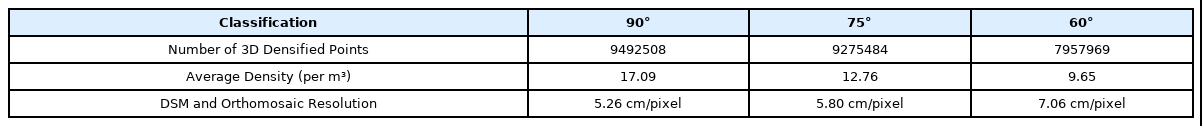

카메라 각도별 고밀도의 포인트 클라우드, DSM, 정사영상은 3D 모델의 구축을 위한 정사영상의 중첩결과와는 상반된 분석결과가 제시되었다(Table 8). 카메라의 각도가 감소될수록 한 장의 정사사진에 포함될 수 있는 사진면적이 증가하는 반면에 고밀도 영상자료를 구성하는 포인트 클라우드는 감소하였다. 3D 고밀도 포인트는 90°를 기준으로 75°가 0.98배, 60°는 0.84배로 감소하였으며 1 m³당 90°는 17.09, 75°는 12.76, 60°는 9.65이 분석되었다. 카메라 각도별 1 pixel의 정사영상의 크기는 90°가 5.26 cm/pixel, 75°가 5.80 cm/pixel, 60°가 7.06 cm/pixel의 해상도가 분석되었다. 따라서, 카메라 각도에 대한 DSM과 정사영상은 카메라 각도가 감소할수록 중복되는 포인트 클라우드가 많아 3D 모델 구축은 많은 위치정보를 담을 수 있지만 결과물의 밀도 및 정확도 측면에서는 카메라 각도가 90° ~ 60°로 감소될수록 감소하는 것으로 분석되었다.

5. 결 론

본 연구에서는 4차 산업혁명의 주요기술 중에 하나인 UAV를 활용하여 수리구조물의 3D 모델을 구축하고 카메라 각도에 따른 정량적인 영향을 평가하였다. 대상지역은 대구광역시 달성군에 위치한 수리구조물로서 사장교 형식의 교량이며 길이는 477 m, 유효폭은 25.5 m이다. UAV는 Phantom4 RTK를 사용하였으며 지형자료의 정확도를 위해 D-RKT 2 GNSS를 설치하여 10 cm 미만의 오차범위로 데이터의 정확도를 확보하였다.

UAV의 카메라 각도는 90°, 75°, 60°에 대하여 관측을 실시하였으며 비행고도, 비행면적, 중첩도, 촬영사진 등의 조건은 모두 동일하게 적용하였다. UAV로 촬영한 항공사진의 X방향, Y방향, Z방향의 포인트 클라우드를 추출하여 DSM과 정사영상을 분석하였다. 카메라 각도별 Images와 Matching은 카메라 각도가 작을수록 많은 면적이 촬영되어 증가하는 것으로 분석되었다. 항공사진을 통한 mapping의 분석결과는 Images는 15° 각도가 감소할 때 1.05배가 Matching은 90° 대비 75°는 1.09배, 60°는 1.60배 증가하였다. 와룡대교의 3D 모델은 카메라의 각도가 감소할수록 관측자료에 대한 3D 모델 포인트가 90° 대비 75°는 1.17배, 60°는 1.47배 증가하였으며 X방향, Y방향, Z방향에 대한 지리위치의 오차는 5 cm 이하로 정확도를 확보하였다.

항공사진으로 분석된 DSM과 정사영상, 3D 모델의 포인트 클라우드의 밀집도는 UAV의 카메라 각도가 감소할수록 감소하는 것으로 분석되었다. DSM과 정사영상은 90°인 5.26 cm/pixel을 기준으로 75°가 1.10배, 60°가 1.34배 증가하였으며 3D 모델은 90°인 17.09 m³를 기준으로 0.75배, 60° 0.56배 감소하였다. 따라서, 카메라 각도가 감소할수록 항공사진에 대한 정확도는 감소하는 것으로 분석되었다. 본 연구에서는 UAV를 활용하여 대구광역시에 위치한 교량의 항공사진은 측량하였으며 DSM과 정사영상, 3D 모델을 구축하였다. 카메라의 각도가 감소할수록 항공사진의 중첩도가 증가하여 구조물의 3D 모델 구축의 정확도는 증가하였다. 그러나, 포인트 클라우드에 대한 밀도는 낮아져서 정밀도는 UAV의 카메라 각도가 작을수록 감소하는 것으로 분석되었다. UAV를 이용한 구조물의 3D 모델 구축은 목적에 따른 정밀도 확보를 위해 다양한 카메라 각도를 조정하여 성과를 구축할 수 있도록 비행계획을 수립해야 한다.

최근 UAV는 다양한 영역에서 활용되고 있으며 방재분야에서는 개발사업에 대한 재해영향을 평가하는 ‘재해영향평가등의 협의 실무지침(2021, 행정안전부)’에서 UAV를 활용하여 사업지구에 전박적인 재해영향을 검토하도록 개정되었다. 또한, 미세먼지 관측, 택배, 관측, 수색 등에서 UAV의 도입을 통해 활용성이 점점 확대되고 있어 정량적인 정확도를 확보할 수 있는 다양한 연구가 필요한 실정이다. 향후 연구로는 UAV를 이용한 측량을 통한 2D의 설계도와 3D 모델을 구축하여 기존 설계도와 BIM, 디지털 트윈 등의 설계의 적용성 및 정확도를 연구하고자 한다.

감사의 글

본 과제는 행정안전부 지역맞춤형 재난안전 연구개발 사업의 지원을 받아 수행된 연구임(20010162).