빌딩 출입 인원 실시간 모니터링을 위한 CCTV 고속 분석 알고리즘

CCTV High-Speed Analysis Algorithm for Real-time Monitoring of Building Access

Article information

Abstract

화재 등 재난 상황에서 피난을 돕는 가장 중요한 정보는 빌딩 내 재실자의 인원 파악과 이동 상황이다. 이를 위하여 출입구에 CCTV를 설치하는 경우에도 육안 모니터링에 의존할 수 밖에 없다. 본 논문은 CCTV에서 수집된 비디오 프레임 이미지로부터 실시간으로 출입 인원 정보를 자동으로 검출하는 시스템을 설명하고 디지털 영상 분석 분야에서 흔히 사용하는 특징 영역 정합 방식을 개선하여 인식률 저하없이 보다 고속으로 분석하는 방안을 제안하였다. 제안하는 방식은 피라미드형 계층 영역 구조를 기반으로 하는 데 최상위 레이어의 해상도가 최하위 레이어 보다 1/16로 압축되도록 설계하였다. 이러한 계층 구조에서 최상위 레이어는 추가적인 분석을 진행할 것인지를 결절하는 트리거 역할을 주로 담당하고, 필요에 따라 하위 레벨의 분석을 진행하는 구조이다. 또한, 상위 레벨의 트리거된 영역과 관계된 부위만을 하위 레벨 레이어에서 처리되도록 하여 전채적인 CPU 소모 시간을 줄였다. 실험 결과, 전체 과정 중에서 특징 추출 단계 시 CPU 요구 시간이 기존 단일 레이어 구조 방식의 13.96% 수준으로 제안하는 방식이 실행 가능함을 확인하였고, 전체 처리 시간 역시도 69.92% 수준으로 단축할 수 있었다.

Trans Abstract

The most important information required to help people escape from disasters such as fires is knowing the number of people that are trapped in the building and their mobility situation. For this purpose, CCTV can be installed and used at entrances, but they do not need to rely on visual monitoring. This paper describes the system of automatically detecting access personnel information from video frame images collected from the CCTV in real time. We propose to improve the region growing method commonly used in the digital image processing field without the degradation of the recognition rate. The proposed method is based on a pyramid-type hierarchical area structure, and is designed to compress the resolution of the top layer to 1/16 of the bottom layer. In this hierarchical structure, the top layer is a casting that primarily serves as a trigger to decide whether to proceed with further analysis and, if necessary, a lower level analysis. In addition, CPU consumption time was reduced by ensuring that only areas related to the high-level triggered areas are processed at the lower-level layers. As a result of the experiment, the proposed layer area analysis method was able to reduce the execution time to 13.96% and the overall processing time to 69.92% over the existing one-layer analysis method.

1. 서 론

융복합 정보 기술과 지능형 센서의 결합은 우리 사회 전반을 유비쿼터스 네트워크로 만들고 있다. 사회 전반적으로 지능형 CCTV 등 각종 센서의 보급이 늘면서 도심의 빌딩 역시도 보다 지능화된 관리와 재난 대처 능력을 갖춘 스마트 빌딩(Smart Building)으로 변모하고 있다.

본 논문은 스마트 빌딩 구현 시 빌딩 내 정보 수집 네트워크의 단말에 위치하는 CCTV 카메라시스템이 갖추어야 할 지능 분석 기술에 관한 것이다. 본 논문은 촬영 기기로부터 실시간으로 입력되는 비디오 이미지를 지능 분석하고 출입 인원에 관한 정보를 추출하는 분석 기술에 관한 것이다(Rosebrock, 2018; Wikipedia, 2019). 이러한 영상 분석 기술은 입력 이미지를 자동 처리하는 디지털 이미지 분석 기술과 영역 특징을 추출하고 분석하는 인공지능 소프트웨어 기술을 기반으로 한다.

이렇게 사람 수를 자동으로 검출(People Counting)하는 기술은 건물 출입구를 통행하는 재실자 관리에 적용하여 빌딩에서 재난 대피를 돕는 중요 정보로 사용될 수 있다. 이 외에도, 백화점 등 상가 입구에 설치하여 출입하는 인원을 셈하는 상권 분석, 위험 지역 등 출입 금지 구역을 지나는 사람들의 안전 관리 등에 적용될 수 있다(Popa et al., 2010). 특히, 도심 빌딩에서 화재나 지진 등 재난 상황이 발생했을 때 건물 내 재실자들은 층별 비상구로 몰릴 수 있다. 이 때 층별 비상구 상황에 근거한 적절한 피난 대책과 정보 제공은 무엇보다 중요하다.

최근 출시되는 지능형 CCTV를 살펴보면 기본적으로 모션 검출 기능이 탑재되기도 하는데, 이것은 주로 이미지의 영역이나 비교적 단순한 화소 변이를 자동 검출하여 CCTV 녹화 시점을 선정하는 트리거(Trigger) 동작이다. 이러한 모션 검출 기능은 화면 전체의 구조적 변화를 분석하기 보다는 특정 영역의 화소값 분포에 의존하기 떄문에 정확한 화면 속 물체 추적이 어렵다. 고 위치 등의 구조적인 변화와 행인의 형태 정보 지식이 포함되는 않는 비교적 단순한 분석이 주류를 이루고 있다. 기존 CCTV가 갖는 충분치 못한 모션 검출 기능은 제한된 컴퓨팅 파워의 임베디드 시스템 구성에서 비롯된 바가 크다. 그러므로 이러한 제한적인 모션 검출 기능만으로는 통행하는 사람의 출입 정보를 정확하게 검출하는 것이 어렵고 주변 환경을 고려한 새로운 분석 방법의 개발이 요구된다고 하겠다.

본 논문은 CCTV 카메라의 지능 분석에 관한 소프트웨어 알고리즘 중에서 사람 수를 자동으로 검출하는 피플 카운팅(People Counting)용 컴퓨터 프로그램에 관한 것이다. 특히, 전체적인 이미지 분석 과정 중에서 분석 특징 추출 단계에 주로 국한하여 보다 빠르게 분석을 진행할 수 있는 알고리즘을 제안한다.

제안하는 분석 방법의 효율성을 보여주기 위하여 일반적인 이미지 영역 분석 기법과 적용 결과를 제안하는 방식의 실험값과 비교하였다. 제안하는 검출 방식은 계층성을 갖는 다단계 레이어 구조로 입력 이미지 프레임을 입체화하여 표현한다. 이러한 계층별 선별 처리에 의해서 전체적인 처리 속도 개선을 시도하였고 그에 따라 전체 시스템의 처리 속도면에서 효율성을 높이고자 하였다.

제안하는 방식의 효율성 실험을 위하여 실제 검출 프로그램을 구현하였다. 구현 프로그램은 비디오 프레임 이미지를 전처리하는 부분, 분석에 사용할 영역 특징을 추출하는 부분과 그 내용을 정합하는 단계를 갖는다.

분석에 사용된 특징은 이미지에서 통행하는 사람의 가능성이 있는 영역의 위치와 해당 영역의 시간별 변이 과정이다. 또한, 이미지 내에서 영역을 분리하는 과정은 재귀적 화소 비교 방식을 주로 사용하기 때문에 시간 소모가 적지 않다. 본 논문에서는 이를 개선하기 위하여 이미지의 특징 추출을 계층적으로 반복 적용하는 방식을 제안하였다.

2. 관련 연구

일반적으로 피플 카운터(People Counter)는 빌딩의 통로나 입구를 지나가는 사람의 수를 측정하는 센서 기구를 의미한다. Ruser and Pavlov (2006) 연구에서는 수동 계측기(Manual Clickers), 적외선 빔 센서(Infrared Beams), 핸드폰 와이파이 추적기(WiFi Trackers)를 이용하는 비교적 단순한 신호 검출 및 처리과정을 소개하고 있다.

보다 높은 인식률을 위해서는 보다 구체적인 상황까지 표현할 수 있는 2D 이미지 분석이 필요하며, CCTV 카메라, 열화상 카메라(Thermal Imaging Cameras) 등이 활용될 수 있다.

일반적으로 피플 카운팅 알고리즘은 크게 두 가지 방법으로 구분할 수 있다. 첫 번째 방법은 직접 접근 방식으로 이미지를 영상분할(Image Segmentation)한 후에 군중 속에서 개인을 직접 구별하도록 하여 분석하는 방식이다. Dittrich et al. (2017)의 연구는 간접 접근 방식으로 분류되며 학습 알고리즘을 사용하여 필요한 분류 정보를 먼저 취하고 전체 이미지의 통계 분석하는 방식이라 할 수 있다.

촬영 카메라를 개인을 구별하기 어려울 정도의 원거리에 설치하여 군중을 분석한 연구도 보고되고 있다. Wang et al. (2015)는 개개인을 구별하기 보다는 군중이 점하는 영역 점유율을 간접 계산하는 방식을 사용하고 있다.

Wang et al. (2010)의 연구는 보다 넓은 뷰(View)를 얻기 위하여 복수의 카메라를 이용하였다. 복수 이미지 간의 겹침 정보는 상호 불일치를 해결하는 도움 정보로 활용될 수 있다.

보통 입력 이미지는 초기 배경 이미지와 현재를 비교하여 새로운 변화 영역을 추출하는 과정을 수행한다(Yao and Odobez, 2007; Niranjil and Sureshkumar, 2015; Huynh-The et al., 2017; Li et al., 2017). 그러므로 안정적인 배경 이미지의 확보가 후반 분석 분류의 성능을 좌우한다.

Cho et al. (2019) 연구는 검출 영역의 특징으로 광학 흐름(Optical Flow)를 이용하였다. Yao and Odobez (2007)는 지역 이진 패턴(Local Binary Patterns, LBP), RGB 화소 값 등이 사용되었다. Farou et al. (2015) 연구에서는 선 가우시안 혼합 모델(Gaussian Mixture Model, GMM)을 적용한 연구 결과도 보고되고 있다.

3. 전체 분석 프로그램의 구성

출입 인원 자동 검출 에이전트(Agent) 프로그램은 빌딩 내 출입구에 설치된 CCTV 영상 정보를 수집하는 서버에서 실행된다.

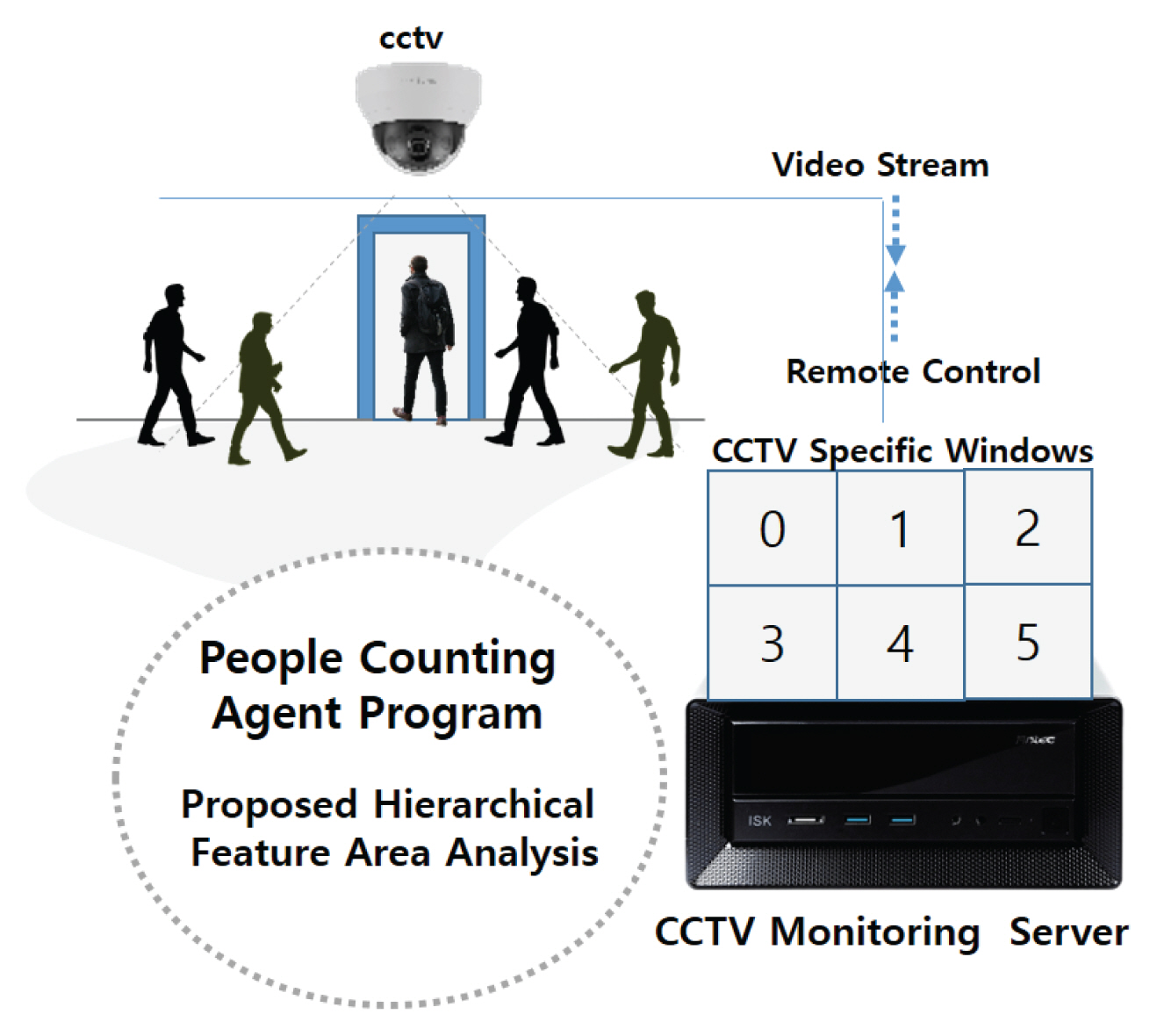

수집되는 재실자의 출입 정보는 상시 수집되어 누적되기 때문에 DB화하여 저장하고 분석할 필요가 있다. 본 논문에서도 Fig. 1과 같이 층별로 현장에 설치된 CCTV 카메라가 있고 관제실 서버는 각각 카메라의 비디오 프레임 이미지를 실시간 수집하고 분석하도록 하였다.

출입 인원 자동 검출 에이전트 프로그램은 4장에서 제안하는 다단계 영역 분석 알고리즘 기반으로 구현되어 서버에서 상시 구동되는 에이전트(Agent)프로그램이다. 본 논문은 이 에이전트 프로그램을 보다 고속화하여 분석의 효율성을 높이는 방안에 관한 것이다.

Fig. 1에서 보듯이 CCTV는 비상구 출입구 천장 부근에 설치하였고 관제실로 수집된 실시간 정보는 화면 오른쪽에 표시되도록 구성하였다. 관제 프로그램은 현재 빌딩을 빠져나간 숫자와 들어온 사람 숫자를 비상구별로 나누어 표시하였다.

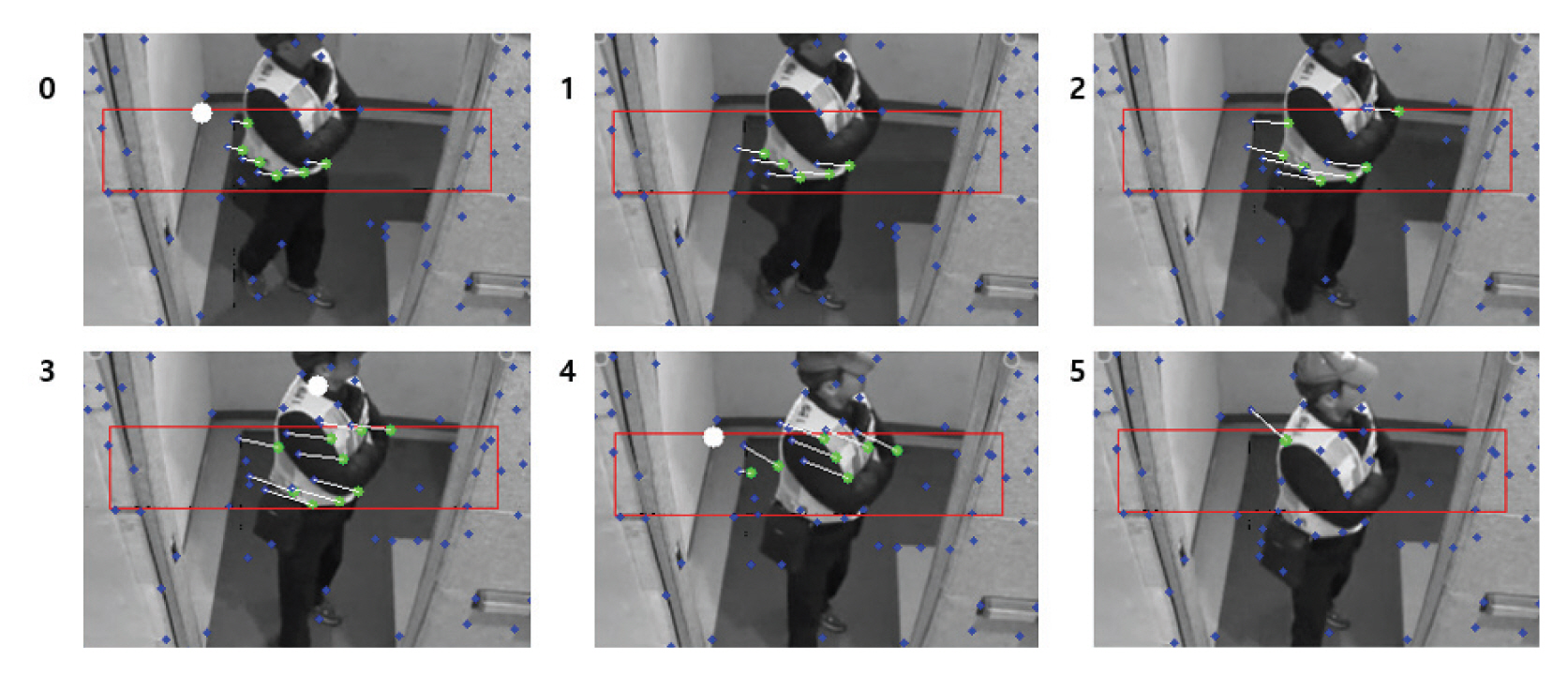

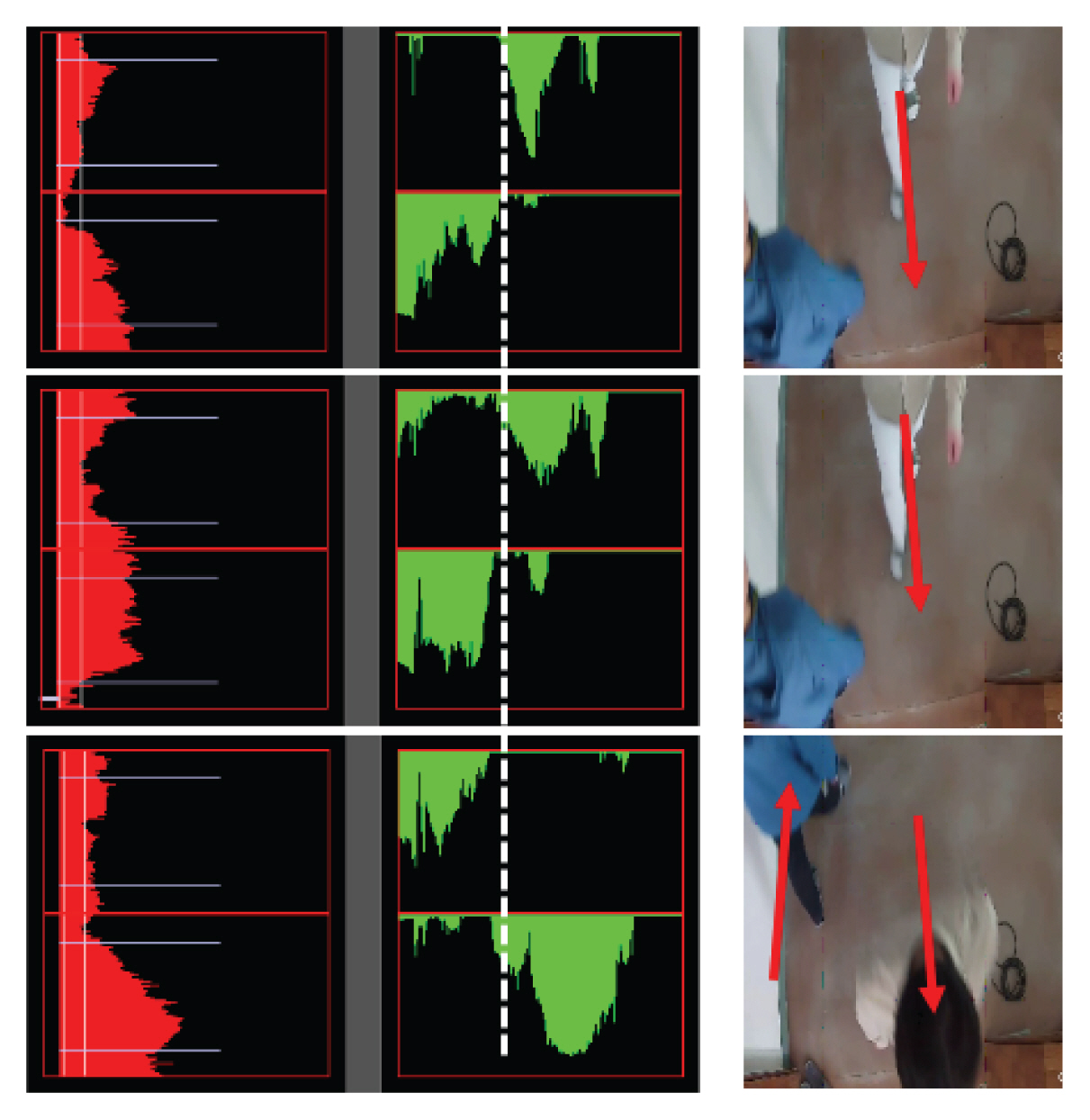

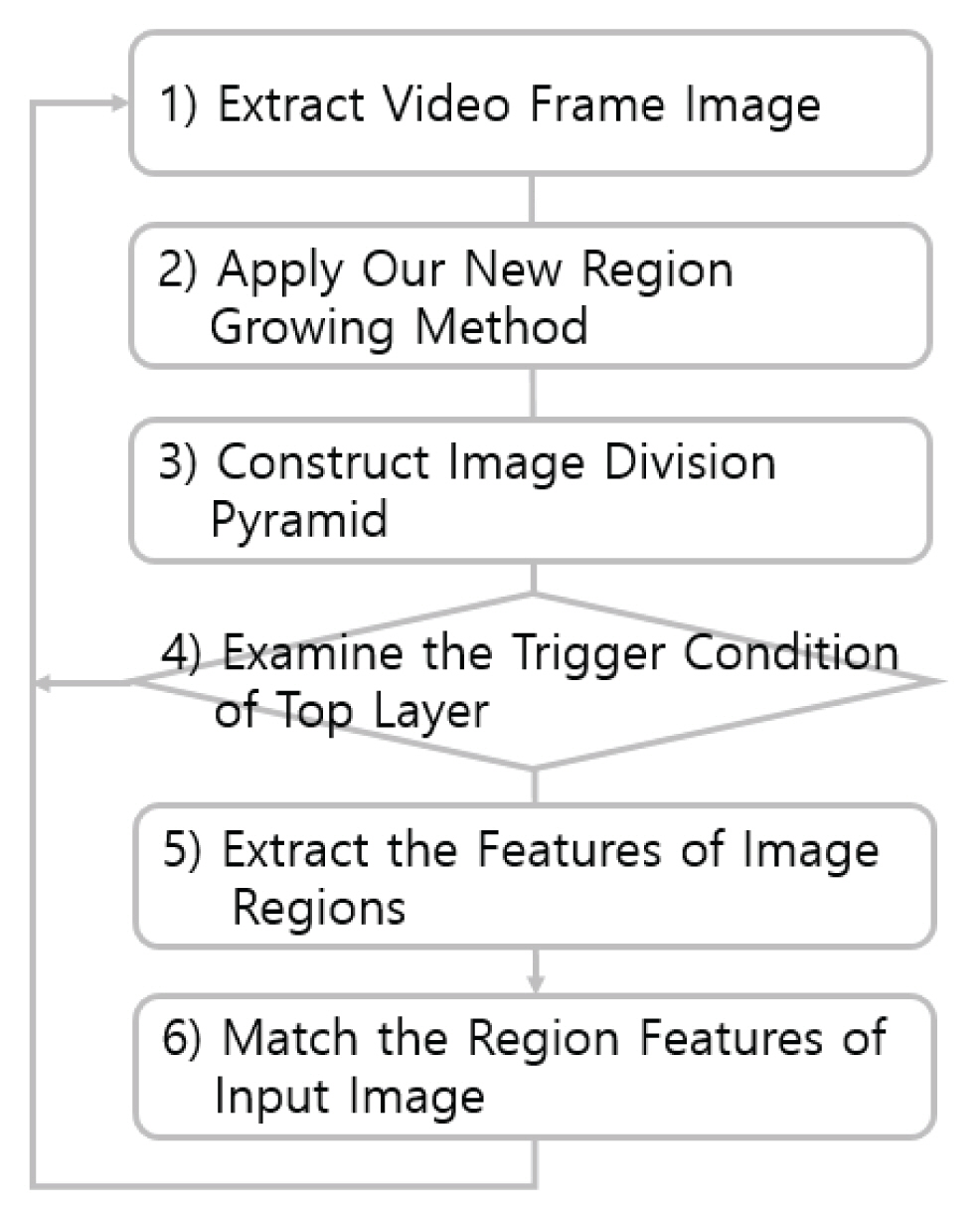

Fig. 2는 본 논문의 전체 분석 시스템의 구성이다. 관제기에 수집된 실시간 프레임 이미지 스트림은 시간 순서대로 처리한다. 분석에 앞서 보다 신뢰성 있고 효과적인 처리를 위해 이미지의 노이즈(Noise)나 플리커(Flicker) 등을 제거하는 전처리 단계와 특징을 추출하고 이를 기 구축된 지식과 정합하여 최종 분류하는 단계로 진행한다. 본 논문에서는 입력되는 비디오 프레임를 격자 모양의 영역으로 구분하고 각 영역별로 특징 값을 추출하여 분석하여 이미지 상의 물체의 이동을 추정하였다. 이미지 변화 검출을 위한 영역특징값으로는 Fig. 3과 같은 광학흐름(Optical Flow) 정보와 Fig. 4와 같은 지역 이진 패턴(LBP)을 사용하였다.

Fig. 4는 제안하는 영역 정합 알고리즘에 따라 이미지 분석이 진행되며 시간에 따른 영역 검출 특징의 변화를 히스토그램의 모양과 발견되는 영역 위치 등으로 보여준다. 그림에서 보듯이 사람의 통행 방향에 따라 히스토그램 누적의 변이 패턴을 확인할 수 있었다.

4. 계층형 특징 영역 분석 알고리즘

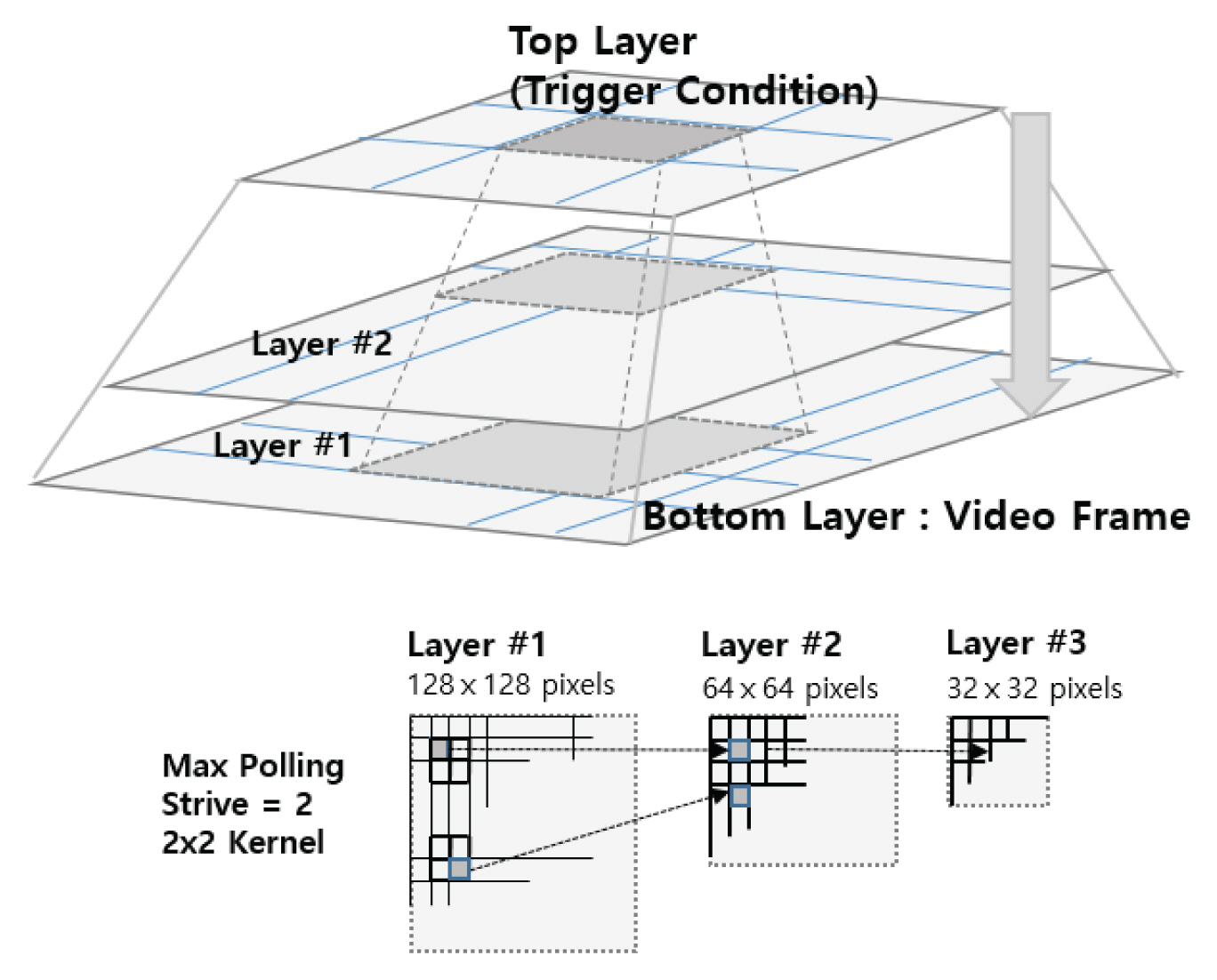

CCTV 카메라의 입력 프레임은 Fig. 5와 같은 다층 레이어 구조로 표현된다. 이 과정으로 출입구에 재실자가 출현 여부, 재실자의 이동 방향, 통행 인원 수 등을 추출할 수 있다. 다층 레이어 구조는 맨 아래 비디오 프레임 이미지를 그대로 표현하는 바닥 레이어, 중간 레이어를 거쳐서 최상위 트리거 레이어(Layer)까지 총 3개로 구성하였다. 최상위 트리거(Trigger) 레이어는 단계적으로 레이어를 거치며 해당 영역 내 화소 값의 평균으로 나타난다. 이 정보는 이미지의 상세한 정보대신 해당 영역을 대표하는 값으로 물체의 출현을 알리는 트리거 역할을 맡는다. 제안하는 알고리즘은 이와 같이 총 3개의 레이어 구조를 기반으로 진행되며 매 단계마다 1/4 크기로 레이어의 해상도가 줄어든다. 결국, 최상위 레이어는 바닥 레이어 영역보다 1/16의 압축 행렬이다.

계층별 레이어의 해상도를 줄여 피라미드 형식으로 정보를 집중시키는 과정에서, 딥러닝 컨벌루션(Convolution)에 사용하는 최대 값 풀링(Max Pooling) 연산을 적용하였다. 이 방법은 평균값 풀링에 비해 이미지 형태 정보의 손실이 다소 있지만 컨벌루션 연산이 빠르기 때문에 본 논문의 주제인 피플 카운팅 응용에 적합하다.

위 연산에서

전체적인 다단계 영역 처리과정은 Fig. 6과 같다. 분석 알고리즘은 입력 프레임 이미지로부터 3단계 레이어를 구성하는 과정으로 시작한다. 최상위 레이어의 트리거 신호 여부를 매 프레임 처리마다 시행한다. 이와 같은 계층적 접근 방식은 전체 이미지를 스캔(Scan)하여 처리하는 것 보다 신속하게 프레임 정보를 처리할 수 있다. 또 이러한 분석 알고리즘은 계층적으로 구성된 이미지를 영역별 특징으로 대분류한 후, 추가 분석을 진행한다, 그러므로 1개의 단일 레이어를 사용하는 방식에 비해 실행 속도 면에서 효율적이다. 일반적으로 영상 처리의 계산량은 이미지 해상도에 비례하여 증가하기 때문에 상위 계층의 대분류는 전체적인 CPU 계산 요구를 낮출 수 있다.

5. 실험 결과

본 논문의 주제인 빌딩 출입구 통행 인원을 자동 검출하는 프로그램의 성능을 측정하는 실험을 진행하였다. 실험에 사용한 CCTV 카메라와 분석 장치의 규격은 Table 1과 같다.

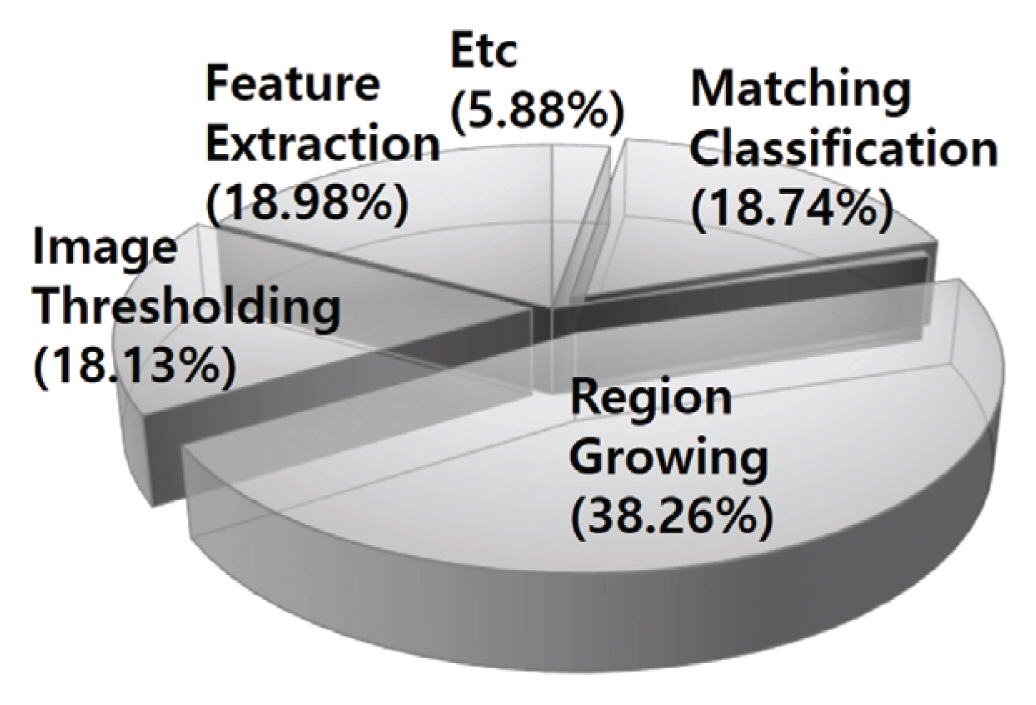

Fig. 7은 분석 프로그램의 처리 단계별 소모 시간을 나타낸다. 그림에서 보듯이 전체 처리 과정 중에서 이미지 전처리에 해당하는 이미지 임계치 변환과 영역 확장(Region Growing) 부분의 소요 시간 비중이 각각 17.19%와 46.03% 였다. 특히 영역 확장 단계는 긴 시간 소모를 보였는 데, 재귀적(Recursive) 스택(Stack) 누적 연산이 진행되었기 때문으로 확인되었다.

통행 인원 분석을 위한 이미지 임계치 변환(Image Thresholding)에서는 통행이 없는 처음 상태를 초기 상태로 지정하고, 현재 입력된 것과 비교하여 새롭게 추가된 부분만 표시하는 차영상(Subtraction Image)을 구한다. 이미지는 최초 RGB 형식에서 회색영상(Grayscale Image)을 거친 후, 화소 값 임계치 변환에서 이진 영상으로 변환하여 처리되는 과정을 거친다. 이 결과 이미지에 특징 추출과 분석 작업을 진행하게 된다.

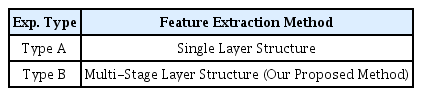

Table 2와 같이 본 논문에서 제안하는 알고리즘과 단독 레이어를 사용하는 일반적인 분석 방식을 실행 시, CPU 소비 자원을 기준으로 그 효율성을 조사하였다.

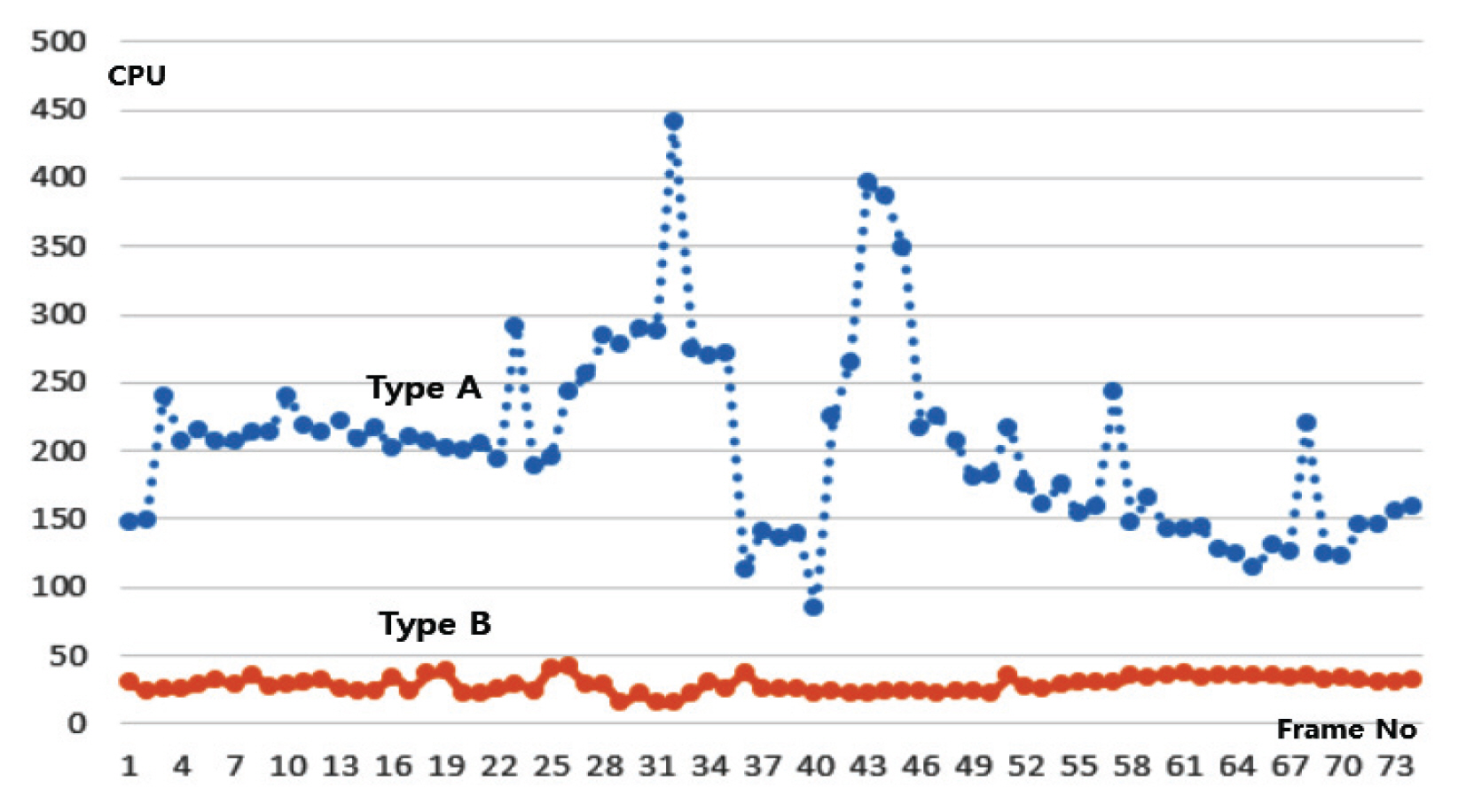

Fig. 8은 추출 프레임별 전체 처리 소모 시간을 나타낸다. 그래프의 수평축은 프레임 순서를 나타내고 수직축은 CPU 처리 시간이며 1/100,000초 단위값이다. 평균적인 프레임 처리 시간은 0.0051초로 측정되었고, 최대 0.0079초의 시간 소모를 보였다. 평균적인 프레임 처리 속도를 볼 때 초당 약 19.6 프레임 내외의 입력을 실시간 처리할 수 있을 것으로 확인되었다. 그림에서 점선은 제안하는 다단계 영역 분류 방식이고 실선은 일반적인 1개 레이어 방식을 나타낸다.

Fig. 9는 전체 소모 시간 중에서 가장 큰 비중을 나타내는 영역 확장 부분의 해당 수치를 보여준다. Fig. 9에서 보듯이 Fig. 8과 그래프의 모양이 비례하는 형태로 보여주는 것을 관찰할 수 있다. 그래프 수직축의 소모 시간 변이를 계산해 보면 Fig. 8의 전체 소모 시간에서 차지하는 비중이 작지 않음을 확인할 수 있었다.

Fig. 9는 전통적인 영역의 특징 검출 방법과 제안하는 검출 방식을 비교하여 나타낸 것이다. 그림에서 아래쪽 실선이 제안하는 영역 분석 방식의 요구 시간이다. 적용한 결과 기존 영역 방식에 비하여 실행 요구 시간을 13.96% 정도만으로 실행될 수 있음을 확인할 수 있었다. 전체적인 이미지 프레임 처리 시간 역시도 69.92% 수준으로 줄일 수 있었다.

Fig. 9에서 그래프 값이 크게 나타나는 지점은 통행인 등장에 따른 영역 확장 연산 때문이다. Fig. 9에서 통행인이 없어도 일정 시간이 소모되는 이유는 노이즈나 의미 없는 물체의 등장 등으로 인한 전처리 소요 시간임을 확인할 수 있었다.

Fig. 10은 영역 확장 후 특징 추출 및 분류에 실행 시간 요구를 보여준다. 앞선 단계와 다르게 프레임별 처리 시간이 일정 구간에서 표시되는 것과 다르게 거의 “0”의 값까지 내려가는 모습을 보이는 것은 의미 있는 특징 추출이 없는 경우이다. Fig. 10에서 통행인의 영역 검출이 이루어 졌더라도 전 단계와 비교했을 때 의미 있는 물체의 이동 변화를 발견하지 못하였거나 그 위치가 비상구 진입 및 진출을 감지하는 트리거 안으로 도달하지 못한 경우는 보다 심화된 분석이 유보된다.

6. 결 론

본 논문은 건물 출입구에 설치하여 출입하는 통행 인원을 검출하는 영상 분석 방법에 관한 것이다. 최근, CCTV 카메라와 같은 보안 장치를 건물 복도 혹은 비상구 등에 설치하는 일이 일반화되고 있어 제안하는 방식을 적용하면 효과적으로 출입 인원 정보 검출이 가능할 것이다. 본 논문에서는 보다 효과적인 인원 계산 알고리즘을 위하여 정합 특징으로 자주 사용되는 영역 분석 기법을 적용하였다. 제안하는 영역 검출 방식을 적용한 결과 기존 영역 방식에 비하여 실행 요구 시간을 13.96%로, 전체 처리 시간 역시 69.92% 수준으로 단축할 수 있었다.

추가 연구로는 화재 시 연무 등으로 시야가 확보되지 않는 경우의 재실자 파악을 위한 센서의 연구와 이 경우 적용할 수 있는 분석 알고리즘이 요구된다. 제안하는 알고리즘은 군집 이동을 하더라도 중간 중간 이동 무리를 구분할 수 있다는 가정 하에서 적용할 수 있으며, 한꺼번에 집단으로 이동하는 경우에는 정확한 인원 파악이 어렵다. 이러한 상황을 고려하여 보다 지능적으로 이미지를 분석할 수 있는 알고리즘의 도출이 필요하다.

Acknowledgements

본 논문은 NST 2018년 국가연구지원사업으로 수행한 과제 “복합재난 대응 피난시스템 기술 개발(위탁과제: 재실자 인원 실시간 모니터링을 위한 영상정보 가시화 모델 개발)”의 결과물임.