|

|

- Search

| J. Korean Soc. Hazard Mitig. > Volume 21(5); 2021 > Article |

|

Abstract

A method of estimating forest-fire fuel loads was developed using drones to collect information about the height and diameter-at-breast-height (DBH) of individual trees. It was conducted for forest fire prevention monitoring (Control, 20% thinned, and 40% thinned area) located in Goseong-gun, Gangwon-do. Object-based images and 3D-model red/green/blue band characteristics were superimposed to select and extract individual trees. A digital crown height model was developed based on the difference between the heights of digital surface and terrain models. In addition, the DBH was estimated based on the crown area. The 40%-thinned area exhibited the highest accuracy (95%) for extracting individual trees, and the difference between the field-survey and drone-image heights was in the range of 0.64-2.02 m. The goodness-of-fit of the DBH-crown area model was 0.61. The difference between the image- and field-survey-based forest-fire fuel loads ranged from -1.20 to 0.40 ton/ha.

мҡ”м§Җ

ліё м—°кө¬м—җм„ңлҠ” м •мӮ¬мҳҒмғҒмқ„ мқҙмҡ©н•ҳм—¬ мһ„лӘ©к°ңмІҙмқҳ мҲҳкі мҷҖ нқүкі м§ҒкІҪмқҳ м •ліҙлҘј мҲҳ집н•ҳкі , мқҙлҘј нҶөн•ҙ мӮ°л¶Ҳм—°лЈҢлҹүмқ„ м¶”м •н• мҲҳ мһҲлҠ” л°©лІ•лЎ мқ„ м ңмӢңн•ҳкі мһҗ н•ҳмҳҖлӢӨ. к°•мӣҗлҸ„ кі м„ұкө°м—җ мң„м№ҳн•ң лҢҖнҳ•мӮ°л¶Ҳл°©м§Җ мҶҢлӮҳл¬ҙмҲІ мӢңн—ҳкө¬(лҢҖмЎ°кө¬, к°„лІҢ 20%, к°„лІҢ 40%)лҘј лҢҖмғҒмңјлЎң мҲҳн–үн•ҳмҳҖлӢӨ. RGB л°ҙл“ңнҠ№м„ұлі„ к°қмІҙкё°л°ҳ мҳҒмғҒмқ„ мқҙмҡ©н•ҳм—¬ к°ңмІҙлӘ©мқ„ м„ лі„н•ҳмҳҖмңјл©°, мҲҳм№ҳн‘ңл©ҙлӘЁлҚё(Digital Surface Model, DSM)кіј мҲҳм№ҳм§Җнҳ•н‘ңкі лӘЁлҚё(Digital Terrain Model, DTM)мқҳ лҶ’мқҙм°ЁлҘј мқҙмҡ©н•ҳм—¬ мҲҳкі лӘЁлҚё(Digital Crown Height Model, DCHM)мқ„ 추м¶ңн•ҳмҳҖлӢӨ. лҳҗн•ң, м„ лі„лҗң к°ңмІҙлӘ©мқҳ мҲҳкҙҖл©ҙм Ғмқ„ мқҙмҡ©н•ҳм—¬ нҳ„мһҘм—җм„ң мёЎм •лҗң нқүкі м§ҒкІҪкіјмқҳ мғҒкҙҖм„ұмқ„ нҢҢм•…н•ҳмҳҖлӢӨ. ліё м—°кө¬ кІ°кіјм—җ мқҳн•ҳл©ҙ, мӢңн—ҳкө¬лі„ нҳ„мһҘм—җм„ң м§Ғм ‘ мёЎм •н•ң мҲҳкі мҷҖ мҳҒмғҒ 추м¶ң мҲҳкі мқҳ м°ЁмқҙлҠ” 0.64 m~2.02 mлЎң лӮҳнғҖлӮ¬мңјл©°, к°ңмІҙлӘ© 추м¶ңмқҳ м •нҷ•лҸ„лҠ” к°„лІҢ 40% мӢңн—ҳкө¬к°Җ 95%лЎң к°ҖмһҘ лҶ’м•ҳлӢӨ. нқүкі м§ҒкІҪ-мҲҳкҙҖл©ҙм Ғ м¶”м •мӢқмқҖ м Ғн•©лҸ„(RВІ) 0.61 мҲҳмӨҖмқ„ ліҙмҳҖмңјл©°, л“ңлЎ мҳҒмғҒ кё°л°ҳ мӮ°л¶Ҳм—°лЈҢлҹү м¶”м •м№ҳмҷҖ нҳ„мһҘмЎ°мӮ¬ кё°л°ҳ кҙҖмёЎм№ҳлҠ” мөңмҶҢ 0.40 ton/ha - мөңлҢҖ 1.20 ton/haмқҳ м°ЁмқҙлҘј ліҙмҳҖлӢӨ.

2019л…„ 4мӣ” 4мқј кі м„ұвӢ…мҶҚмҙҲм—җм„ң л°ңмғқн•ң лҢҖнҳ•мӮ°л¶ҲлЎң 1,757 haмқҳ мӮ°лҰјкіј мЈјнғқ 916мұ„ мҶҢмӢӨ л“ұ мқҙлЎң мқён•ң н”јн•ҙм•ЎмқҖ м•Ҫ 1,291м–ө мӣҗм—җ лӢ¬н–ҲлӢӨ(KFS, 2019). мқҙмҷҖ к°ҷмқҙ көӯлӮҙмҷём ҒмңјлЎң лҸ„мӢ¬нҳ• мӮ°л¶Ҳ л°ңмғқмқҙ кёүмҰқн•Ём—җ л”°лқј мӮ°лҰјмқём ‘м§Җ мЈјліҖмқ„ лҢҖмғҒ мңјлЎң мӮ°л¶Ҳ н”јн•ҙ м Җк°җмқ„ мң„н•ң мӮ°лҰј лӮҙ м—°лЈҢкҙҖлҰ¬кё°мҲ к°ңл°ңмқҳ н•„мҡ”м„ұмқҙ лҶ’м•„м§Җкі мһҲлӢӨ(Hussam and Akshat, 2018). мӮ°лҰјмқё м ‘м§Җ мЈјліҖмқҳ мӮ°лҰјмқ„ нҡЁмңЁм ҒмңјлЎң кҙҖлҰ¬н•ҳкё° мң„н•ҙм„ңлҠ” мһ„분 лӢЁмң„(Stand level)мқҳ мЎ°л°©м Ғ м—°лЈҢкҙҖлҰ¬ мІҙкі„лҘј л„ҳм–ҙ м ңкұ° мһ„лӘ© к№Ңм§Җ м„ лі„к°ҖлҠҘн•ң мҲҳмӨҖмқё мҶҢк·ңлӘЁ м •л°Җ м—°лЈҢкҙҖлҰ¬мІҙкі„ л§Ҳл Ёмқҙ мҡ”кө¬лҗңлӢӨ(Cruz et al., 2004; Cruz et al., 2005). мҶҢк·ңлӘЁ к°ңмІҙлӘ© лӢЁмң„(Tree level)мқҳ м •л°Җ분м„қмқ„ мӢӨнҳ„н•ҳкё° мң„н•ҙм„ңлҠ” лӢӨм–‘н•ң нҳ•нғңмқҳ мҳҒмғҒмқ„ мқҙмҡ©н•ҳм—¬ мҶҗмүҪкІҢ мһ„분л°ҖлҸ„(Stand density), мҲҳкі (Tree height), нқүкі м§ҒкІҪ(Diameter at breast height) л“ұ мӮ°лҰјм •ліҙлҘј м¶”м •н• мҲҳ мһҲм–ҙм•ј н•ҳл©°, мқҙлҹ¬н•ң мӮ°лҰјм •ліҙлЎң мӮ°лҰј лӮҙ нғҲ мҲҳ мһҲлҠ” л¬јм§Ҳмқҳ м–‘кіј нҠ№м„ұмқ„ нҢҢм•…н•ҳлҠ” кё°мҲ мқҙ к°ңл°ңлҗҳм–ҙ м•ј н•ңлӢӨ(Chen et al., 2006; Kwak et al., 2007; Strigul, 2012).

мӮ°лҰј 분야м—җм„ңлҠ” мң„м„ұмҳҒмғҒ, н•ӯкіөмӮ¬м§„, LiDAR л“ұмқ„ мқҙмҡ© н•ҳм—¬ мӮ°лҰјмһҗмӣҗ м •ліҙлҘј к°„м ‘ м¶”м •н•ҳлҠ” мӣҗкІ©нғҗмӮ¬ кё°мҲ мқҙ нҷңмҡ© лҗҳкі мһҲлӢӨ(Hyyppa et al., 2001; Andersen et al., 2004). мң„м„ұкіј н•ӯкіөкё°м—җл§Ң мқҳмЎҙн•ҳлҚҳ мҳҒмғҒ м •ліҙ мҲҳ집мқҖ мөңк·ј л“ңлЎ (UAV) кё°мҲ мқҙ л°ңм „н•Ём—җ л”°лқј мһҗмң мһҗмһ¬лЎң мҳҒмғҒ м •ліҙлҘј м·Ёл“қн• мҲҳ мһҲлҠ” мІҙкі„к°Җ л§Ҳл Ёлҗҳм—ҲлӢӨ. л“ңлЎ мқҖ мӮ¬мҡ©мһҗк°Җ мүҪкІҢ мЎ°мў…н• мҲҳ мһҲмңјл©°, кё°мЎҙ н•ӯкіөмҳҒмғҒмқҙлӮҳ мң„м„ұмҳҒмғҒкіј лӢ¬лҰ¬ лҶ’мқҖ кі н•ҙмғҒлҸ„ мҳҒмғҒмқ„ м Җ비мҡ©мңјлЎң м–»мқ„ мҲҳ мһҲлҠ” мһҘм җмқҙ мһҲлӢӨ(Tian et al., 2017). кіјкұ°м—җлҠ” мҙ¬мҳҒ мҳҒмғҒмқ„ 분м„қм—җ нҷңмҡ©н•ҳл Өл©ҙ кі н’Ҳм§Ҳмқҳ м •нҷ•лҸ„ лҶ’мқҖ мқҙлҜём§Җ мғқм„ұмқҖ н•„мҲҳм ҒмқҙмҳҖлӢӨ(Dimitrios et al., 2016). к·ёлҹ¬лӮҳ мөңк·ј Structure from Motionм—җм„ң нҢҢмғқлҗң лӢӨмӨ‘ к°ҒлҸ„ мқҙлҜём§ҖлҘј 추м¶ңн•ҳлҠ” мҙҲкі н•ҙмғҒлҸ„ л””м§Җн„ё лӘЁлҚё кё°мҲ мқҙ л°ңм „н•Ём—җ л”°лқј мқјл°ҳ мҳҒмғҒмңјлЎңлҸ„ м–јл§Ҳл“ м§Җ м •ліҙлҘј к°Җкіөн•ҳкі л¶„м„қн• мҲҳ мһҲлҠ” мІҙкі„к°Җ л§Ҳл Ёлҗҳм—ҲлӢӨ(Fritz et al., 2013; James and Robson, 2012; Ota et al., 2015).

мөңк·ј л§ҺмқҖ м—°кө¬м§„мқҖ л“ңлЎ мҳҒмғҒмһҗлЈҢлҘј кё°л°ҳмңјлЎң мӢңкі„м—ҙ мӮ°лҰјкө¬мЎ° ліҖнҷ”, мһҘкё°лӘЁлӢҲн„°л§Ғ м—°кө¬мҷҖ нғ„мҶҢм ҖмһҘлҹү, мһ„лӘ©мһ¬м Ғ л°Ҹ мҲҳнҷ•лҹү м¶”м • л“ұм—җ мқҙмҡ©н•ҳкі мһҲмңјл©°, м—°кө¬ мҳҒм—ӯмқ„ м§ҖмҶҚм Ғмңј лЎң нҷ•лҢҖн•ҳкі мһҲлӢӨ(Diaz-Varela et al., 2014; Gini et al., 2014; Edson and Wing, 2011; Zarco-Tejada et al., 2014), мӮ°л¶Ҳ분야 м—җм„ңлҸ„ л“ңлЎ мқ„ мқҙмҡ©н•ң м—°кө¬к°Җ 추진лҗҳкі мһҲлӢӨ. л“ңлЎ мҳҒмғҒкіј мқёкіөм§ҖлҠҘн•ҷмҠөмқ„ мқҙмҡ©н•ң мӮ°л¶Ҳм—°лЈҢ лӘЁлӢҲн„°л§Ғ м—°кө¬к°Җ лҢҖн‘ңм Ғ мқҙл©°, м ңкұ°лӘ© кіөк°„ 분м„қ л°Ҹ м„ лі„ л“ұ мӮ°л¶Ҳн”јн•ҙм Җк°җмқ„ мң„н•ң мӮ°л¶Ҳм—°лЈҢкҙҖлҰ¬ мқҳмӮ¬кІ°м •мӢңмҠӨн…ң к°ңл°ң м—°кө¬к°Җ мқҙлЈЁм–ҙм§Җкі мһҲ лӢӨ(Cruz et al., 2002; David, 2010). н•ңнҺё, көӯлӮҙм—җм„ңлҠ” мӮ°лҰјкіө 간분м„қ, мҲҳ종분лҘҳ л“ұ мӮ°лҰјм •ліҙ мһҗлЈҢ кө¬м¶•мқ„ мң„н•ң кё°мҙҲм Ғмқё м—°кө¬лҠ” к°„н—җм ҒмңјлЎң мҲҳн–үлҗҳкі мһҲмңјлӮҳ(Lim et al., 2016; Park and Jang, 2018; Kim and Kwon, 2020), мӮ°л¶Ҳн•ҷ кҙҖм җм—җм„ң мҲҳн–үн•ң м—°кө¬лҠ” м „л¬ҙн•ң мӢӨм •мқҙлӢӨ.

ліё м—°кө¬м—җм„ңлҠ” л“ңлЎ м •мӮ¬мҳҒмғҒмқ„ нҷңмҡ©н•ҳм—¬ к°ңмІҙлӘ©мқ„ 분лҘҳ н•ҳкі мҲҳкі лҘј 추м¶ңн•ҳм—¬ 추м¶ңлҘ л°Ҹ м Ғн•©лҸ„лҘј нҸүк°Җн•ҳмҳҖлӢӨ. лҳҗн•ң, 추м¶ңлҗң мҲҳкі мҷҖ мҲҳкҙҖл©ҙм Ғм—җ л”°лҘё нқүкі м§ҒкІҪ м •ліҙлҘј мқҙмҡ©н•ҳм—¬ н•ҙлӢ№ мӮ°лҰј лӮҙм—җм„ң мӮ°л¶ҲлЎң мқён•ҙ нғҲ мҲҳ мһҲлҠ” к°Җм—°л¬јм§Ҳмқҳ м–‘мқ„ 분м„қн•ҳлҠ” л°©лІ•лЎ мқ„ м ңмӢңн•ҳкі мһҗ н•ңлӢӨ.

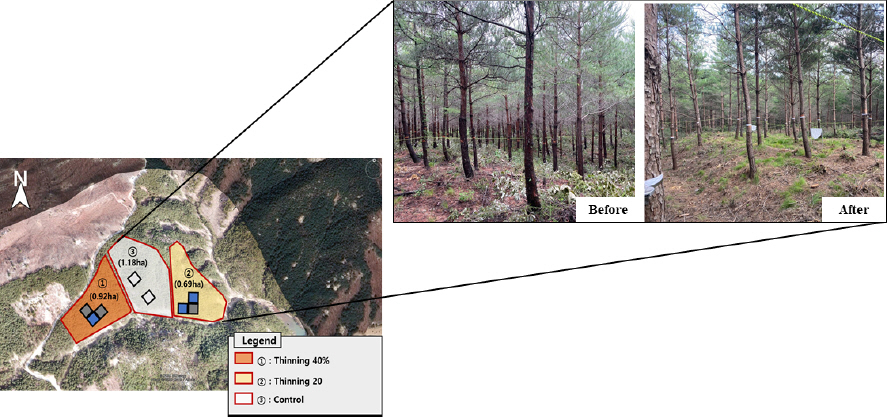

м—°кө¬лҢҖмғҒм§ҖлҠ” к°•мӣҗлҸ„ кі м„ұкө° мЈҪмҷ•л©ҙ мқјлҢҖ көӯмң лҰј лӮҙ мң„м№ҳ н•ң мҶҢлӮҳл¬ҙлҰјмңјлЎң 2000л…„ лҸҷн•ҙм•Ҳ мӮ°л¶Ҳн”јн•ҙ нӣ„ мҶҢлӮҳл¬ҙ мҲҳмў…мқ„ мЎ°лҰјн•ң м§Җм—ӯмқҙлӢӨ. мһ„л №мқҖ 24л…„мғқ в…ўмҳҒкёү мһ„분мңјлЎң нҸүк· нқүкі м§ҒкІҪ 14.0 cm, нҸүк· мҲҳкі 9.5 m, м§Җн•ҳкі 4.1 mмқҳ нҠ№м„ұмқ„ ліҙмқҙлҠ” мһ„분мқҙлӢӨ(Fig. 1).

ліё мӢңн—ҳкө¬лҠ” мҲҳкҙҖнҷ” нҷ•мӮ° л°©м§ҖлҘј мң„н•ң м Ғм •мһ„분л°ҖлҸ„ кё°мӨҖ мңјлЎң мҲІк°Җкҫёкё°лҘј 진н–үн•ң мһ„분(к°„лІҢ 40%), лӘ©мһ¬мғқмӮ°мҡ© ліёмҲҳ лҢҖ비 кё°мӨҖм—җ мқҳн•ҙ мҲІк°Җкҫёкё°лҘј 진н–үн•ң мһ„분(к°„лІҢ 20%), мҲІк°Җ кҫёкё°лҘј 진н–үн•ҳм§Җ м•ҠмқҖ лҢҖмЎ°кө¬ мһ„분мңјлЎң лӮҳлҲ„м–ҙ к°Ғ 3л°ҳліөмңјлЎң мІҳлҰ¬н•ң мһ„분мқҙлӢӨ(KFS, 2012; 2016).

DJIмӮ¬м—җм„ң к°ңл°ңн•ң Mavic Pro мһҘ비м—җ Hasselblad L1D-20c м№ҙл©”лқј(2,000л§Ң Pixel)лҘј нғ‘мһ¬н•ң л“ңлЎ мқ„ мқҙмҡ©н•ҳм—¬ 2021л…„ 3мӣ” 20мқјм—җ лҢҖмғҒм§ҖлҘј мҙ¬мҳҒн•ҳмҳҖлӢӨ. мҙ¬мҳҒкі лҸ„лҠ” н•ҙмғҒлҸ„мҷҖ мЈј ліҖ м§Җнҳ•м§Җл¬ј нҠ№м„ұмқ„ кі л Өн•ҳм—¬ 200 mлЎң м„Өм •н•ҳмҳҖмңјл©°, лӮҙмӨ‘ мІ©мңЁ(End lap)кіј мҳҶмӨ‘мІ©мңЁ(Side lap)мқ„ 80% мқҙмғҒмңјлЎң м„Өм • 비н–үн•ҳмҳҖлӢӨ. мҳҒмғҒмҙ¬мҳҒлІ”мң„лҠ” мӢӨм ң м—°кө¬лҢҖмғҒм§Җ л©ҙм Ғ 3.70 haліҙлӢӨ л„“мқҖ 37.93 haлЎң м„Өм •н•ҳм—¬ к°ҖмһҘмһҗлҰ¬мқҳ мҷңкіЎм—җ мқҳн•ң 분м„қмҳӨлҘҳлҘј л°©м§Җн•ҳмҳҖмңјл©°, DJIмӮ¬м—җм„ң м ңкіөн•ҳлҠ” DJI GO м•ұ мқ„ мқҙмҡ©н•ҳм—¬ мһҗлҸҷ비н–үлӘЁл“ңлЎң мҙ¬мҳҒн•ҳмҳҖлӢӨ.

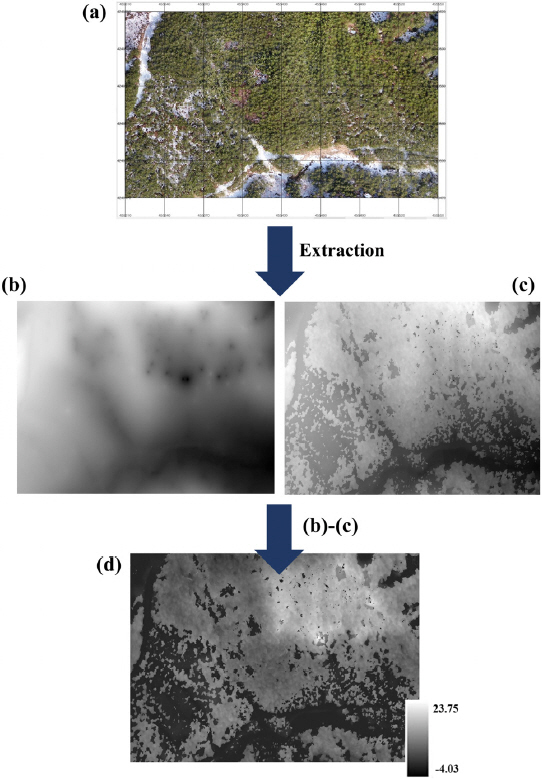

Pix 4D Mapper мҶҢн”„нҠёмӣЁм–ҙлҘј мқҙмҡ©н•ҳм—¬ мҙ¬мҳҒ кіјм •м—җм„ң л°ңмғқн•ң л“ңлЎ мқҳ нқ”л“ӨлҰј, м№ҙл©”лқјмқҳ к°ҒлҸ„, л ҢмҰҲмқҳ мҷңкіЎ л“ұ л¶Ҳмҷ„м „ мҡ”мҶҢл“Өм—җ лҢҖн•ң нӣ„мІҳлҰ¬лҘј 진н–үн•ҳмҳҖлӢӨ(Table 1). GNSS/IMU м •ліҙлҘј мқҙмҡ©н•ҳм—¬ мҳҒмғҒмқҳ мң„м№ҳ, кі лҸ„ л“ұ мң„м№ҳліҙм •мқ„ мҲҳн–үн•ң мһҗлЈҢлҘј кё°л°ҳмңјлЎң мҳҒмғҒмқ„ м •н•©н•ҳмҳҖмңјл©°, мқҙнӣ„ Point CloudлҘј нҶөн•ҙ мҲҳм№ҳн‘ңл©ҙлӘЁлҚё(Digital Surface Model, DSM)лҘј мғқм„ұн•ҳ мҳҖлӢӨ. DSMмқҖ мӨ‘мІ©мӮ¬м§„мқ„ мһҗлҸҷм ҒмңјлЎң л§Өм№ӯмӢңмјң м–»мқҖ кІ°кіјлЎң л§Өм№ӯмҳӨлҘҳм—җ лҢҖн•ң ліҙм •мқ„ мң„н•ҙ н•„н„°л§Ғмқ„ мҲҳн–үн•ҳмҳҖлӢӨ(Chang et al., 2006). мІҳлҰ¬кіјм •м—җм„ңмқҳ мҳӨлҘҳмҷҖ мҲҳкҙҖмёө мҳҒм—ӯмқҳ кІҪкі„лҘј л¶Җл“ңлҹҪкІҢ ліҙм •н•ҳкё° мң„н•ҙ Noise filteringкіј Smoothing filtering мқ„ мӢӨмӢңн•ҳмҳҖлӢӨ. лҳҗн•ң мқёкіөкө¬мЎ°л¬јкіј мҲҳлӘ© л“ұ м§Җн‘ңн”јліөл¬јм—җ лҢҖн•ң лҶ’мқҙлҘј м ңкұ°н•ң мҲңмҲҳ кі лҸ„лӘЁнҳ•мқё мҲҳм№ҳм§Җнҳ•н‘ңкі лӘЁлҚё(Digital Terrain Model, DTM)мқ„ 추м¶ңн•ҳкё° мң„н•ҙ м—ӯкұ°лҰ¬к°ҖмӨ‘лІ•(Inverse distance weighted)лҘј мқҙмҡ©н•ҙ ліҙк°„мһ‘м—…мқ„ 진н–үн•ҳмҳҖлӢӨ.

лҢҖнҳ•мӮ°л¶Ҳл°©м§Җ мҶҢлӮҳл¬ҙмҲІ мӢңн—ҳкө¬ лӮҙ м„Өм№ҳлҗң к°„лІҢк°•лҸ„(лҢҖмЎ° кө¬, к°„лІҢ 40%, к°„лІҢ 20%) л°©нҳ•кө¬лҘј лҢҖмғҒмңјлЎң мӮ°лҰјнҳ„мһҘмЎ°мӮ¬ лҘј мҲҳн–үн•ҳмҳҖлӢӨ. 20 m Г— 20 m нҒ¬кё°мқҳ л°©нҳ•кө¬ лӮҙ мғқмңЎн•ҳкі мһҲлҠ” нқүкі м§ҒкІҪ 6 cm мқҙмғҒ к°ңмІҙлӘ©мқ„ лҢҖмғҒмңјлЎң Vertex в…ЈлҘј мқҙмҡ©н•ҳм—¬ мҲҳкі лҘј мёЎм •н•ҳмҳҖмңјл©°, нқүкі м§ҒкІҪ мёЎм •мқҖ м§ҒкІҪн…Ңмқҙ н”„лҘј мқҙмҡ©н•ҳмҳҖлӢӨ. к°ңмІҙлӘ©мқҳ мң„м№ҳм •ліҙлҠ” мӮ°лҰј лӮҙ мқёкіөмң„м„ұкіј GPSк°„мқҳ мҶЎмӢ мқҙ мӣҗнҷңн•ҳм§Җ м•ҠмқҖ м җмқ„ к°җм•Ҳн•ҳм—¬ н‘ңмӨҖм§Җ лӮҙ мӨ‘мӢ¬м—җ мң„м№ҳн•ҳлҠ” к°ңмІҙлӘ©(мӨ‘мӢ¬м җ)мқ„ кё°мӨҖмңјлЎң кұ°лҰ¬мҷҖ л°©мң„к°Ғ мқ„ мёЎм •н•ҳм—¬ мң„м№ҳм •ліҙлҘј м¶”м •н•ҳмҳҖлӢӨ. к·ё нӣ„ нҳ„мһҘм—җм„ң м–»мқҖ мӢӨм ң мһ„лӘ©мң„м№ҳм •ліҙмҷҖ мҳҒмғҒмң„м№ҳм •ліҙлҘј мқјм№ҳмӢңнӮӨлҠ” нӣ„мІҳлҰ¬ мһ‘м—…мқ„ мҲҳн–үн•ҳмҳҖлӢӨ.

2.2.3.1 к°қмІҙм§Җн–Ҙ мҳҒмғҒл¶„н• (Object-oriented image seg-mentation)

мҳҒмғҒ분м„қмқ„ мң„н•ҙ System for Automated Geoscientific Alaysis (SAGA) н”„лЎңк·ёлһЁкіј мҳӨн”ҲмҶҢмҠӨмқё QGIS 3.20мқ„ мқҙмҡ© н•ҳмҳҖлӢӨ. ліё м—°кө¬м—җм„ңлҠ” м Җн•ҙмғҒлҸ„ мҳҒмғҒм—җ мқҙмҡ©лҗҳлҠ” н”Ҫм…Җкё°л°ҳ мҳҒмғҒ분м„қмқҙ м•„лӢҢ к°қмІҙкё°л°ҳ мҳҒмғҒ분м„қ кё°мҲ мқ„ мӮ¬мҡ©н•ҳмҳҖлӢӨ. мӮ¬мҡ©н•ң к°қмІҙм§Җн–ҘмҳҒмғҒл¶„н• мқҙлһҖ мҳҒмғҒл¶„н• мӢң 분кҙ‘м •ліҙмҷҖ кіөк°„ м •ліҙлҘј лҸҷмӢңм—җ мқҙмҡ©н•ҳм—¬ лӘЁм–‘мқҙлӮҳ 분кҙ‘м •ліҙк°Җ к· мқјн•ң мҳҒм—ӯмқё мҳҒмғҒк°қмІҙлҘј л§Ңл“ңлҠ” кё°мҲ лЎңм„ң мҳҒмғҒл¶„н• (Image segmentation) м—җ кё°мҙҲн•ҳм—¬ кіөк°„н•ҙмғҒлҸ„к°Җ лҶ’мқҖ мҳҒмғҒ분м„қм—җ м„ нҳёлҗҳкі мһҲлӢӨ (Carleer et al., 2005; Edson and Wing, 2011).

к°қмІҙм§Җн–Ҙ мҳҒмғҒл¶„н• мқҖ л¶„н• кіјм •м—җм„ң Bandмқҳ нҒ¬кё°, кіөк°„нҠ№ м„ұ, кіөк°„мң„м№ҳ, мһ„кі„к°’м—җ лҢҖн•ң к°ҖмӨ‘м№ҳм—җ л”°лқј 분лҘҳ м •нҷ•лҸ„к°Җ лӢ¬лқјм§Ҳ мҲҳ мһҲкё° л•Ңл¬ём—җ(Lee et al., 2007), к°ңмІҙлӘ© 추м¶ңм—җ м Ғн•©н•ң мҲҳм№ҳ м„Өм •мқ„ мң„н•ң л°ҳліө 분м„қмқ„ мӢӨмӢңн•ҳмҳҖлӢӨ. к°қмІҙ л¶„н• мқ„ мӢӨмӢңн•ң мҳҒмғҒмқҖ RGB л°ҙл“ңнҠ№м„ұмқ„ кі л Өн•ҳм—¬ Red л°ҙл“ң лҠ” мһ„лӘ©кө¬м—ӯ, Blue л°ҙл“ңлҠ” м§Җл©ҙкө¬м—ӯ, Gray л°ҙл“ңлҠ” к·ёлҰјмһҗкө¬м—ӯ мңјлЎң лӮҳлҲ„м—ҲлӢӨ. м§Җл©ҙмң„м—җ мҢ“мқё лҲҲмқҖ 분м„қмһҗ нҢҗлӢЁн•ҳм—җ н‘ңліёк°’ мқ„ м§Ғм ‘ м§Җм •н•ҳм—¬ 분лҘҳн•ҳмҳҖлӢӨ. мөңмў…м ҒмңјлЎң к°Ғк°Ғмқҳ мҳҒмғҒм—җм„ң н‘ңліёкіј 피분лҘҳ лҢҖмғҒм—җ лҢҖн•ң н‘ңліёк°’мқ„ м„Өм •н•ҳмҳҖмңјл©°, н‘ңліёмқҳ к°’кіј мң мӮ¬н•ң нҠ№м§•мқ„ к°–лҠ” к°ңмІҙл“Өмқ„ мһҗлҸҷм„ нғқн•ҳкі , к·ёлЈ№нҷ”н•ҳ лҠ” к°җлҸ…분лҘҳ(Supervised classfication)лҘј мӢӨмӢңн•ҳмҳҖлӢӨ.

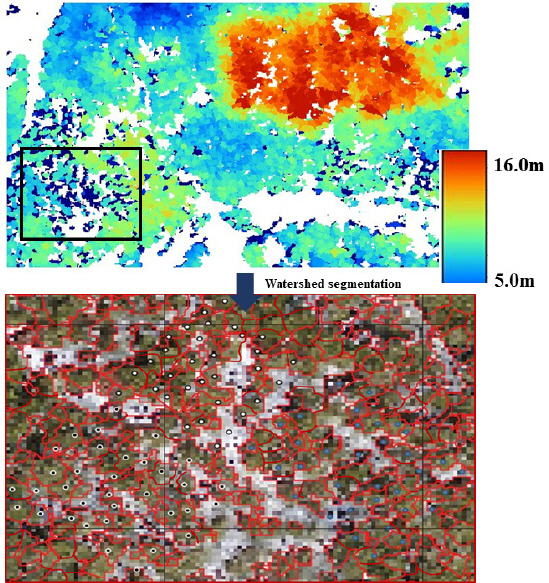

2.2.3.2 к°ңмІҙлӘ© мҲҳкі м¶”м • л°©лІ•

DSMкіј DTMмқҳ мҲҳм№ҳм •ліҙ м°ЁмқҙлҘј нҶөн•ҙ м§Җл©ҙм—җ мЎҙмһ¬н•ҳлҠ” к°қмІҙмқҳ лҶ’мқҙк°’мқ„ мқҳлҜён•ҳлҠ” мҲҳкі лӘЁлҚё(Digital Crown Height Model, DCHM)мқ„ 추м¶ңн•ҳмҳҖлӢӨ(Cho and Kim, 2010). мқҙнӣ„ к°қмІҙкё°л°ҳ мҳҒмғҒ분м„қмқ„ нҶөн•ҙ л¶„н• лҗң нҸҙлҰ¬кіӨкіј DCHMмқ„ мӨ‘мІ©мӢң мјң лҶ’мқҙ к°’мқ„ к°ңмІҙлӘ©м—җ м Ғмҡ©н•ҳмҳҖлӢӨ. мғқм„ұлҗң мҳҒмғҒмқ„ Watershed segmentation кё°лҠҘмқ„ мқҙмҡ©н•ҳм—¬ к°ңмІҙлӘ© лӢЁмң„лЎң л¶„н• н•ҳмҳҖмңјл©°, кІ°кіјл¬јмқ„ мқҙмҡ©н•ҙ к°„лІҢк°•лҸ„лі„ к°ңмІҙлӘ© 추м¶ңлҘ (Extaction rate) кіј 추м¶ңм •нҷ•лҸ„(Extraction accuracy)лҘј 분м„қн•ҳмҳҖлӢӨ.

мӮ°л¶Ҳм—°лЈҢлҹүмқ„ м¶”м •н•ҳкё° мң„н•ҙ мҲҳкҙҖл©ҙм Ғмқ„ ліҖмҲҳлЎң н•ҳлҠ” нқүкі м§ҒкІҪ м¶”м •мӢқмқ„ к°ңл°ңн•ҳмҳҖлӢӨ. мҲҳкҙҖл©ҙм ҒмқҖ к°қмІҙкё°л°ҳ мҳҒмғҒ 분м„қмқ„ нҶөн•ҙ мһ„лӘ©мқҳ мҲҳкҙҖмҳҒм—ӯмқ„ 추м¶ңн•ң кІ°кіјк°’м—җ лӢЁл©ҙм Ғмқ„ мӮ°м¶ңн•ҳм—¬ м¶”м •н•ҳмҳҖлӢӨ. мҲҳкҙҖл©ҙм Ғкіј нқүкі м§ҒкІҪкіјмқҳ мғҒкҙҖкҙҖкі„ 분м„қмқ„ мң„н•ҙ н”јм–ҙмҠЁ мғҒкҙҖкҙҖкі„ л°©лІ•мқ„ мқҙмҡ©н•ҳм—¬ л‘җ ліҖмҲҳ мӮ¬мқҙмқҳ мң мқҳмҲҳмӨҖмқ„ мӮ°м¶ңн•ҳмҳҖлӢӨ.

Kim (2015)мқҙ м—°кө¬лҘј нҶөн•ҙ к°ңл°ңн•ң нқүкі м§ҒкІҪмқ„ ліҖмҲҳлЎң н•ҳлҠ” мҶҢлӮҳл¬ҙ мӮ°л¶Ҳм—°лЈҢлҹү лҢҖмҲҳнҡҢк·ҖмӢқ(Eq. (2))м—җм„ң ОІ0 :-2.380, ОІ1:1.637мқ„ мқҙмҡ©н•ҳм—¬ мӢӨм ң нҳ„мһҘмЎ°мӮ¬лҘј нҶөн•ҙ м¶”м •лҗң мӮ°л¶Ҳм—° лЈҢлҹүкіј мҳҒмғҒ분м„қмқ„ нҶөн•ҙ м¶”м •лҗң мӮ°л¶Ҳм—°лЈҢлҹүк°„мқҳ м°ЁмқҙлҘј 비көҗвӢ…분м„қн•ҳмҳҖлӢӨ.

л“ңлЎ м—җ нғ‘мһ¬лҗң GNSS/IMU м„јм„ңлҘј нҶөн•ҙ м·Ёл“қн•ң мҷёл¶Җн‘ңм • мҡ”мҶҢмҷҖ нҠ№м§•м җ 추м¶ң л°©мӢқмқ„ мқҙмҡ©н•ҳм—¬ мҳҒмғҒмқ„ м •н•©н•ҳмҳҖлӢӨ. м •н•©кіјм •м—җм„ң лӮұмһҘл§ҲлӢӨ н•ҙмғҒлҸ„к°Җ м°Ёмқҙк°Җ л°ңмғқн•ҳлҠ”лҚ°, мҙқ 1,227л§Ө мҙ¬мҳҒ мӮ¬м§„ мӨ‘ н•ҙмғҒлҸ„к°Җ лӮ®м•„ ліҙм •мқҙ лҗҳм§Җ м•ҠмқҖ 48л§Өмқҳ мӮ¬м§„мқ„ 비нҷңм„ұнҷ” мІҳлҰ¬н•ҳкі , лӮҙл¶Җн‘ңм •мҡ”мҶҢм—җ мқҳн•ҙ ліҙм •лҗң 1,179л§Өл§Ңмқ„ мӮ¬мҡ©н•ҳмҳҖлӢӨ. мғқм„ұлҗң мҳҒмғҒм—җм„ң ліё м—°кө¬лҢҖ мғҒм§Җк°Җ мң„м№ҳн•ң л¶Җ분мқ„ мһ„мқҳмқҳ Shpfileмқ„ мғқм„ұн•ҳм—¬ лі„лҸ„лЎң 추м¶ңн•ҳмҳҖлӢӨ. 추м¶ңн•ң м •мӮ¬мҳҒмғҒмқҳ л©ҙм ҒмқҖ м•Ҫ 3.7 haмқҙм—Ҳмңјл©° м•Ҫ 2.42 cmмқҳ кі н•ҙмғҒлҸ„ мҳҒмғҒмқ„ нҡҚл“қн• мҲҳ мһҲм—ҲлӢӨ.

DSMмқҳ н•ҙмғҒлҸ„лҠ” 2.42 cmкёү мқҙм—Ҳкі , DTMмқҳ н•ҙмғҒлҸ„лҠ” м•Ҫ 30 cmкёүмқҙ 추м¶ңлҗҳм—ҲлӢӨ. DSMкіј DTMмқҳ м°ЁлҘј мқҙмҡ©н•ҳм—¬ мҲҳкҙҖл¶Җ лҶ’мқҙм—җ лҢҖн•ң лӘЁлҚёмқё DCHMмқ„ мғқм„ұн•ң кІ°кіј, мҳҒмғҒм—җм„ң к°ҖмһҘ л°қмқҖ мҳҒм—ӯмқҖ 23.75 m, к°ҖмһҘ м–ҙл‘җмҡҙ мҳҒм—ӯмқҖ -4.03 mмқҙм—Ҳ лӢӨ. DCHMмқҖ м§Җл©ҙ мң„ кө¬мЎ°л¬јм—җ лҢҖн•ң лҶ’мқҙлҘј лӮҳнғҖлӮҙкё° л•Ңл¬ём—җ мқҙлЎ м ҒмңјлЎң 0 мқҙн•ҳмқҳ мҲҳм№ҳлҘј к°Җм§Ҳ мҲҳ м—ҶмңјлӮҳ, ліё м—°кө¬м—җм„ңлҠ” -4.03 mк№Ңм§Җ мҳӨм°Ёк°Җ л°ңмғқн•ҳмҳҖлӢӨ. мқҙлҹ° кІ°кіјлҠ” DTMмқ„ мғқм„ұн• л•Ң Point Cloudк°Җ м—ҶлҠ” мһ„мқҳмқҳ м§Җм җм—җ лҢҖн•ң к°’мқ„ мҳҲмёЎн• л•Ң л°ңмғқн•ң мҳӨм°ЁлЎң нҢҗлӢЁлҗңлӢӨ.

분м„қмқ„ нҶөн•ҙ 추м¶ңн•ң м •мӮ¬мҳҒмғҒ, DSM, DTM, DCHM лӘЁлҚё мқҖ лӢӨмқҢкіј к°ҷлӢӨ(Fig. 2).

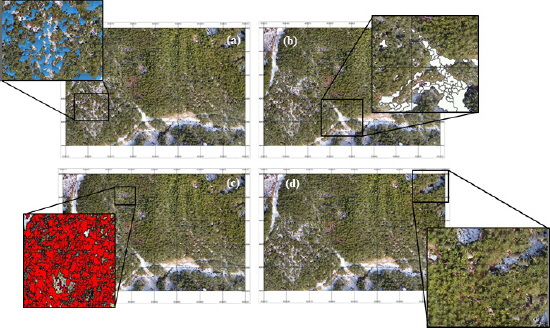

Grays мҳҒмғҒм—җм„ң 140 лҜёл§ҢмңјлЎң лӮҳнғҖлӮң к°қмІҙлҠ” вҖҳк·ёлҰјмһҗвҖҷ, Red мҳҒмғҒм—җм„ң 140 мқҙмғҒ 210 мқҙн•ҳлЎң лӮҳнғҖлӮң к°қмІҙлҠ” вҖҳмһ„лӘ©вҖҷ, Blue мҳҒмғҒм—җм„ң 165 мқҙмғҒмңјлЎң лӮҳнғҖлӮң к°қмІҙлҠ” нҶ м–‘ лҳҗлҠ” м•”м„қ мқ„ мқҳлҜён•ҳлҠ” вҖҳкё°нғҖм§Җм—ӯвҖҷмқҙлқјкі м„Өм •н•ҳмҳҖлӢӨ. м§Җн‘ңл©ҙ мң„м—җ мҢ“여진 лҲҲмқҖ н‘ңліёк°’мқ„ м§Ғм ‘ л¶Җм—¬н•ҳмҳҖмңјл©°, к°Ғк°Ғмқҳ мҳҒмғҒм—җ лҢҖн•ң кІ°кіјл¬јмқ„ мғқм„ұн•ҳмҳҖлӢӨ(Fig. 3).

к°қмІҙ분лҘҳлҗң мҳҒмғҒмһҗлЈҢм—җм„ң к·ёлҰјмһҗмҷҖ кё°нғҖм§Җм—ӯмқ„ м ңкұ°н•ҳ м—¬ мөңмў…м ҒмңјлЎң к°ңмІҙлӘ©мқ„ л¶„н• н• мһ„лӘ©м§Җм—ӯмқ„ мғқм„ұн•ҳмҳҖлӢӨ(Fig. 4). мғқм„ұлҗң мһ„лӘ©м§Җм—ӯ мҳҒмғҒкіј DCHM мһҗлЈҢлҘј мӨ‘мІ©мӢңнӮЁ нӣ„ лҶ’мқҙм—җ лҢҖн•ң мҶҚм„ұм •ліҙлҘј мһ…л Ҙн•ҳкі , Watershed segmentation algorithmмқ„ мқҙмҡ©н•ҳм—¬ мөңмў…м ҒмңјлЎң к°ңмІҙлӘ© лӢЁмң„лЎң л¶„н• н•ҳмҳҖ лӢӨ. н•ҙлӢ№ мһ„분 лӮҙ нҸүк· мҲҳкі (9.5 m)ліҙлӢӨ лӮ®мқ„ кІҪмҡ° кҙҖлӘ©, мҲҳк°„ л“ұмңјлЎң мҳӨмқёмӢқн•ҳм—¬ мҳҒмғҒ분лҘҳ м •нҷ•лҸ„к°Җ лӮ®м•„м§Ҳ мҲҳ мһҲкё° л•Ңл¬ём—җ мҲҳкі лҶ’мқҙ 5 m мқҙн•ҳлҠ” мһ„мқҳлЎң м ңкұ° н•ҳмҳҖлӢӨ.

к°„лІҢк°•лҸ„м—җ л”°лқј мӢӨм ң нҳ„мһҘмЎ°мӮ¬мҷҖ мҳҒмғҒлӮҙ мҲҳкі м¶”м¶ң кІ°кіј лҘј 비көҗн•ң кІ°кіјлҠ” лӢӨмқҢкіј к°ҷлӢӨ(Table 2).

Tree Extraction and Tree Height Extraction Results According to Thinning type

лҢҖмЎ°кө¬мқҳ кІҪмҡ° мӢӨм ң к°ңмІҙлӘ© ліёмҲҳлҠ” 83ліёмқҙм—ҲмңјлӮҳ, мҳҒмғҒ분 м„қмқ„ нҶөн•ҙ 추м¶ңн•ң к°ңмІҙлӘ© 52ліёмңјлЎң 추м¶ңмңЁмқҖ 63%, 추м¶ңм •нҷ• лҸ„лҠ” м•Ҫ 58% мҲҳмӨҖмқҙм—ҲлӢӨ. к°„лІҢ 20% мӢңн—ҳкө¬мқҳ мӢӨм ң к°ңмІҙлӘ© ліёмҲҳлҠ” 52ліё, мҳҒмғҒ분м„қмқ„ нҶөн•ҙ 추м¶ңн•ң к°ңмІҙлӘ©мқҖ 53.3ліёмңјлЎң 107%мқҳ кіјлҢҖм¶”м •лҗҳм—Ҳмңјл©°, 85% мҲҳмӨҖмқҳ 추м¶ңм •нҷ•лҸ„лҘј ліҙмҳҖ лӢӨ. к°„лІҢ 40% мӢңн—ҳкө¬мқҳ мӢӨм ң к°ңмІҙлӘ© ліёмҲҳлҠ” 33.3ліё, мҳҒмғҒ분м„қ мқ„ нҶөн•ҙ 추м¶ңн•ң к°ңмІҙлӘ©мқҖ 33.7ліёмңјлЎң 추м¶ңм •нҷ•лҸ„лҠ” 95%мқё лҶ’мқҖ мҲҳмӨҖмқ„ ліҙм—¬ н•ҙлӢ№ кіөк°„ лӮҙ мһ„лӘ©мқҙ л„“кІҢ 분нҸ¬н• мҲҳлЎқ 추м¶ң м •нҷ•лҸ„к°Җ лҶ’м•„м§ҖлҠ” кІҪн–Ҙмқ„ ліҙмҳҖлӢӨ. мқјл°ҳм ҒмңјлЎң мӮ°лҰјкҙҖ лҰ¬к°Җ мҲҳн–үлҗҳм§Җ м•ҠмқҖ мһ„분м—җм„ңлҠ” л“ңлЎ мҳҒмғҒ лӮҙ к°ңмІҙлӘ©мқ„ м„ лі„ н•ҳлҠ” кІғмқҙ м–ҙл Өмҡҙ кІғмңјлЎң м•Ңл Өм ё мһҲмңјлӮҳ(Diaz-Varela et al., 2015), к°„лІҢмқҙ мӢңн–үлҗң мӢңн—ҳкө¬м—җм„ңлҠ” м•Ҫ 85% мқҙмғҒ мҲҳмӨҖмқҳ к°ңмІҙлӘ©мқ„ 추м¶ңн• мҲҳ мһҲлҠ” к°ҖлҠҘм„ұмқ„ ліҙм—¬мЈјм—ҲлӢӨ. лӢӨл§Ң к°„лІҢмқҙ мӢңн–үлҗң мӢңн—ҳкө¬м—җм„ң кіјлҢҖ추м¶ңмңЁмқ„ ліҙмҳҖлҠ”лҚ°, мқҙлҠ” мҳҒмғҒл¶„н• лӢЁкі„м—җм„ң мҲҳкҙҖмӨ‘мІ©лҘ мқҙ лӮ®мқҢмңјлЎң мқён•ҙ к·ёлҰјмһҗмҳҒм—ӯ, кҙҖлӘ©мёө л“ұ кё°нғҖмҳҒм—ӯм—җ лҢҖн•ң к°ңмІҙлӘ© мӢқлі„мқҙ мҳӨмқёмӢқлҗң кІғмңјлЎң ліҙмқёлӢӨ (Paproki et al., 2012; Song, 2020). 추нӣ„ м…ҖнҒ¬кё° мЎ°м Ҳ л“ұмқ„ нҶөн•ҙ мҲҳкҙҖмӨ‘мІ©лҘ мқ„ мҳ¬лҰ°лӢӨл©ҙ м •нҷ•лҸ„к°Җ лҶ’мқҖ к°ңмІҙлӘ© мҲҳкі м¶”м¶ңмқҙ к°ҖлҠҘн• кІғмңјлЎң ліҙмқёлӢӨ.

к°„лІҢ к°•лҸ„м—җ л”°лҘё к°ңмІҙлӘ©мқҳ мҲҳкі лҘј 추м¶ңн•ң кІ°кіј, лҢҖмЎ°кө¬мқҳ кІҪмҡ° мҳҒмғҒм—җм„ң 추м¶ңн•ң мҲҳкі к°Җ 6.90 mлЎң нҳ„мһҘм—җм„ң м§Ғм ‘ мёЎм • н•ң мҲҳкі 8.92 mліҙлӢӨ м•Ҫ 2.02 m лӮ®кІҢ м¶”м •лҗҳм—ҲлӢӨ. к°„лІҢ 20% мӢңн—ҳкө¬лҠ” мҳҒмғҒм—җм„ң 추м¶ңн•ң мҲҳкі мқё 7.97 mмқҙ нҳ„мһҘм—җм„ң м§Ғм ‘ мёЎм •н•ң мҲҳкі к°’мқё 9.08 mліҙлӢӨ м•Ҫ 1.12 m лӮ®кІҢ м¶”м •лҗҳм—Ҳмңјл©°, к°„лІҢ 40% мӢңн—ҳкө¬лҠ” нҳ„мһҘм—җм„ң м§Ғм ‘ мёЎм •н•ң мҲҳкі мҷҖ мҳҒмғҒ 추м¶ң мҲҳкі мқҳ м°Ёмқҙк°Җ 0.64 mм—җ л¶Ҳкіјн•ҳм—¬ к°„лІҢк°•лҸ„к°Җ лҶ’мқ„мҲҳ лЎқ мёЎм • мҳӨм°Ёк°Җ м җм°Ё мһ‘м•„м§ҖлҠ” кІҪн–Ҙмқ„ ліҙмҳҖлӢӨ. мҳҒмғҒ분лҘҳ кё°л°ҳн•ң мЈјмҡ” м№Ём—ҪмҲҳмў… мҲҳкі м¶”м¶ң кҙҖл Ё м„ н–үм—°кө¬кІ°кіјм—җм„ң м ңмӢңн•ң нҸүк· мҲҳкі мҳӨм°ЁлҠ” м•Ҫ 1.28 m~1.89 mмқҙмҳҖлӢӨ(Jan et al., 2017; Pabi et al., 2020; Kim et al., 2021). ліё м—°кө¬кІ°кіјмҷҖ 비көҗн•ҙ лҙӨмқ„ л•Ң, лҢҖмЎ°кө¬ мһ„분мқҖ кё°мЎҙ м„ н–үм—°кө¬кІ°кіј нҸүк· мҲҳкі мҳӨм°Ё лҢҖ비 мөңлҢҖ 157% лҶ’мқҖ мҳӨм°ЁмңЁмқ„ ліҙмқё л°ҳл©ҙ, к°„лІҢ 40% мӢңн—ҳкө¬лҠ” кё°мЎҙ м„ н–үм—°кө¬кІ°кіј лҢҖ비 мөңлҢҖ 50% лӮ®мқҖ мҳӨм°Ё мңЁмқ„ ліҙмҳҖлӢӨ.

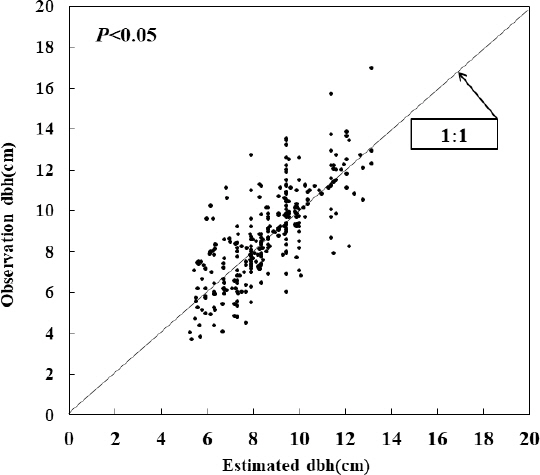

мҳҒмғҒм—җм„ң 분лҘҳлҗң мҲҳкҙҖл©ҙм Ғ м¶”м •м№ҳмҷҖ нқүкі м§ҒкІҪ кҙҖмёЎм№ҳк°„ мқҳ мғҒкҙҖм„ұмқ„ 분м„қн•ң кІ°кіј, мҲҳкҙҖл©ҙм Ғмқҙ л„“м–ҙм§ҲмҲҳлЎқ нқүкі м§ҒкІҪ лҳҗн•ң мҰқк°Җн•ҳлҠ” м–‘мқҳ мғҒкҙҖм„ұмқ„ ліҙмҳҖлӢӨ. л‘җ ліҖмҲҳ к°„мқҳ мғҒкҙҖ분м„қ мқ„ мӢӨмӢңн•ң кІ°кіј мң мқҳмҲҳмӨҖм—җм„ң лҶ’мқҖ мғҒкҙҖм„ұмқ„ ліҙмҳҖмңјл©° (P < 0.01), нқүкі м§ҒкІҪ-мҲҳкҙҖл©ҙм Ғ м¶”м •мӢқмқҖ м Ғн•©лҸ„(RВІ) 0.61мҲҳ мӨҖмқ„ ліҙмҳҖлӢӨ(Fig. 5).

нқүкі м§ҒкІҪ м¶”м •м№ҳмҷҖ мӢӨм ң мӮ°лҰјмЎ°мӮ¬лҘј нҶөн•ҙ м–»м–ҙ진 нқүкі м§Ғ кІҪ кҙҖмёЎм№ҳмқ„ мқҙмҡ©н•ҳм—¬ мӮ°л¶Ҳм—°лЈҢлҹүмқ„ 비көҗвӢ…분м„қн•ҳмҳҖлӢӨ. лЁј м Җ, м¶”м •лҗң нқүкі м§ҒкІҪмқҳ лІ”мң„лҠ” 11.82 cm~20.67 cmлЎң лӮҳнғҖлӮ¬ мңјл©°, кҙҖмёЎлҗң нқүкі м§ҒкІҪмқҖ 9.50 cm~24.12 cmмқҳ лІ”мң„лҘј ліҙмҳҖ лӢӨ. м¶”м •лҗң нқүкі м§ҒкІҪкіј кҙҖмёЎлҗң нқүкі м§ҒкІҪмқҖ мөңмҶҢ -4.22 cmм—җ м„ң мөңлҢҖ 5.02 cmк№Ңм§Җ м°Ёмқҙк°Җ мһҲм—Ҳмңјл©°, л‘җ 집лӢЁк°„ нҸүк· м ңкіұк·ј нҺём°ЁлҠ” 2.68 cmмқҙм—ҲлӢӨ(Fig. 6). кё°мЎҙ м„ н–үм—°кө¬кІ°кіјм—җ м„ңлҸ„ нҸүк· м ңкіұк·ј нҺём°ЁлҘј 2.05 cmлЎң м ңмӢңн•ң л°” мһҲм–ҙ ліё м—°кө¬мқҳ кІ°кіјмҷҖ мң мӮ¬н•ҳмҳҖлӢӨ(Koji, 1997).

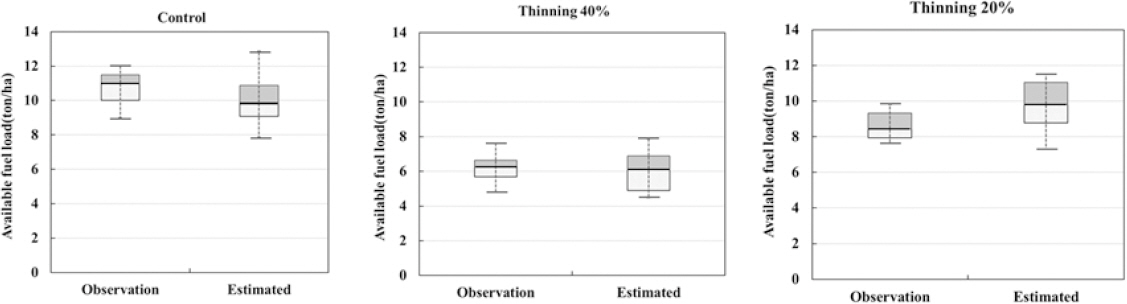

мӮ°л¶Ҳмқҙ л°ңмғқн–Ҳмқ„ л•Ң к°Җм—°л¬јм§ҲлЎң мһ‘мҡ©н•ҳлҠ” м—°мҶҢк°ҖлҠҘн•ң мҲҳкҙҖм—°лЈҢлҹүмқ„ 분м„қн•ң кІ°кіј, лҢҖмЎ°кө¬мқҳ кІҪмҡ° нқүкі м§ҒкІҪ м¶”м •мӢқ мқ„ мқҙмҡ©н•ң мҲҳкҙҖм—°лЈҢлҹүмқҖ 9.94 ton/haмңјлЎң кҙҖмёЎлҗң мҲҳкҙҖм—°лЈҢлҹү мқё 11.14 ton/haліҙлӢӨ м•Ҫ 1.20 ton/ha лӮ®кІҢ м¶”м •лҗҳм—ҲлӢӨ. к°„лІҢ 20% мӢңн—ҳкө¬лҠ” нқүкі м§ҒкІҪ м¶”м •мӢқмқ„ мқҙмҡ©н•ң мҲҳкҙҖм—°лЈҢлҹүмқҙ 9.01 ton/haмңјлЎң кҙҖмёЎлҗң мҲҳкҙҖм—°лЈҢлҹү 8.61 ton/haліҙлӢӨ м•Ҫ 0.40 ton/ha кіјлҢҖм№ҳлҘј ліҙмҳҖлӢӨ. к°„лІҢ 40% мӢңн—ҳкө¬лҠ” нқүкі м§ҒкІҪ м¶”м •мӢқмқ„ мқҙмҡ©н•ң мҲҳкҙҖм—°лЈҢлҹүмқҙ 5.70 ton/haмңјлЎң кҙҖмёЎлҗң мҲҳкҙҖм—°лЈҢлҹү 6.00 ton/haліҙлӢӨ м•Ҫ 0.20 ton/ha кіјмҶҢм№ҳлҘј ліҙмҳҖлӢӨ(Fig. 7). нқүкі м§ҒкІҪ м¶”м •мӢқмқ„ мқҙмҡ©н•ҳм—¬ м¶”м •н•ң мҲҳкҙҖм—°лЈҢлҹүкіј мӢӨм ң нҳ„мһҘмЎ°мӮ¬лҘј нҶөн•ҙ м¶”м •н•ң мҲҳкҙҖм—°лЈҢлҹүмқ„ 비көҗн•ң кІ°кіј, л‘җ м¶”м • мӢқ лӘЁл‘җ лҢҖмЎ°кө¬ мһ„분мқҙ к°„лІҢмқҙ мӢңн–үлҗң мӢңн—ҳкө¬м—җ 비н•ҙ мҲҳкҙҖм—° лЈҢлҹүмқҙ мғҒлҢҖм ҒмңјлЎң лҶ’м•ҳлӢӨ.

ліё м—°кө¬м—җм„ңлҠ” л“ңлЎ м •мӮ¬мҳҒмғҒм •ліҙлЎң мһ„лӘ©к°ңмІҙмқҳ мҲҳкі мҷҖ нқүкі м§ҒкІҪ м •ліҙмҲҳ집мқ„ нҶөн•ҙ мӮ°л¶Ҳм—°лЈҢлҹүмқ„ м¶”м •н•ҳлҠ” л°©лІ•лЎ мқ„ м ңмӢңн•ҳкі мһҗ н•ҳмҳҖлӢӨ. м—°кө¬лҢҖмғҒм§ҖлҠ” к°•мӣҗлҸ„ кі м„ұкө°м—җ мң„м№ҳ н•ң лҢҖнҳ•мӮ°л¶Ҳл°©м§Җ мҶҢлӮҳл¬ҙмҲІ мӢңн—ҳкө¬лЎң к°„лІҢк°•лҸ„(лҢҖмЎ°кө¬, к°„лІҢ 20%, к°„лІҢ 40%) лі„ 3л°ҳліөмңјлЎң кө¬м„ұлҗҳм–ҙ мһҲлӢӨ. мӮ°лҰјм •ліҙмҲҳ집 мқ„ мң„н•ҙ RGB л°ҙл“ңнҠ№м„ұлі„ к°қмІҙкё°л°ҳ мҳҒмғҒкіј 3м°Ёмӣҗ мҲҳкі лӘЁлҚё мқ„ мӨ‘мІ©мӢңмјң к°ңмІҙлӘ©мқ„ м„ лі„ л°Ҹ 추м¶ңн•ҳмҳҖкі , к°ңмІҙлӘ©лі„ мҲҳкҙҖл©ҙ м Ғм—җ л”°лҘё нқүкі м§ҒкІҪмқ„ м¶”м •н•ҳмҳҖлӢӨ. к·ё кІ°кіј, к°„лІҢк°•лҸ„лі„ к°ңмІҙлӘ© 추м¶ңм •нҷ•мңЁмқҖ к°„лІҢ 40% мӢңн—ҳкө¬м—җм„ң 95%лЎң к°ҖмһҘ лҶ’м•ҳмңјл©°, нҳ„мһҘм—җм„ң м§Ғм ‘ мёЎм •н•ң мҲҳкі мҷҖ мҳҒмғҒ 추м¶ң мҲҳкі мқҳ м°ЁмқҙлҠ” лҢҖмЎ°кө¬ 2.02 m, к°„лІҢ 20% мӢңн—ҳкө¬ 1.12 m, к°„лІҢ 40% 0.64 mмңјлЎң кі к°•лҸ„ мһ„분мқјмҲҳлЎқ мҲҳкі мҳӨм°ЁлҠ” лӮ®м•„м§ҖлҠ” кІғмңјлЎң ліҙмҳҖлӢӨ.

нқүкі м§ҒкІҪ-мҲҳкҙҖл©ҙм Ғ м¶”м •мӢқмқ„ мқҙмҡ©н•ҳм—¬ мӢӨм ң кҙҖмёЎлҗң мӮ°л¶Ҳ м—°лЈҢлҹүкіј л“ңлЎ мҳҒмғҒ кё°л°ҳ мӮ°л¶Ҳм—°лЈҢлҹүмқ„ 비көҗвӢ…분м„қн•ң кІ°кіј мөңмҶҢ 0.40 ton/ha - мөңлҢҖ 1.20 ton/haмқҳ м°ЁмқҙлҘј ліҙмҳҖлӢӨ. м „мІҙм Ғ мңјлЎң мӢӨм ң кҙҖмёЎк°’мқҖ м¶”м •м№ҳм—җ 비н•ҙ кіјмҶҢмёЎм •лҗҳлҠ” кІҪн–Ҙмқ„ ліҙмҳҖлӢӨ. мқҙлҹ¬н•ң мӣҗмқёмқҖ к°„лІҢк°•лҸ„лі„ мӢңн—ҳкө¬лҠ” к°Ғкё° лӢӨлҘё м§Җнҳ• кіј мһ„분조кұҙмқ„ к°Җм§Җкі мһҲмңјлӮҳ, DTM 추м¶ңмӢң кІ©мһҗнҒ¬кё°, 분м„қ к°ҒлҸ„, мқҙкІ©кұ°лҰ¬ л“ұмқ„ кі л Өн•ҳм§Җ м•Ҡкі лҸҷмқјн•ң мЎ°кұҙ н•ҳм—җ нӣ„мІҳлҰ¬ мһ‘м—…мқ„ мҲҳн–үн–Ҳкё° л•Ңл¬ёмңјлЎң ліҙмқёлӢӨ. 추нӣ„ м—¬лҹ¬ мЎ°кұҙлі„ DTM мғқм„ұ л°Ҹ н•„н„°л§Ғ 분м„қмқ„ мҲҳн–үн•ҳл©ҙ мҲҳкі м¶”м¶ңм—җ лҢҖн•ң м •нҷ•лҸ„лҘј лҶ’мқј мҲҳ мһҲмқ„ кІғмңјлЎң нҢҗлӢЁлҗңлӢӨ.

ліё м—°кө¬лҠ” мӢӨм ң мӮ°лҰјмЎ°мӮ¬к°Җ м•„лӢҢ л“ңлЎ мҳҒмғҒл§ҢмңјлЎң мӮ°лҰјм • ліҙлҘј мҲҳ집н•ҳм—¬ н•ҙлӢ№ мһ„분 лӮҙ мӮ°л¶Ҳм—°лЈҢлҹүмқ„ м¶”м •н• мҲҳ мһҲлҠ” л°©лІ•лЎ мқ„ м ңмӢңн•ң м—°кө¬мқҙлӢӨ. ліё м—°кө¬кІ°кіјм—җм„ң мӢӨм ң нҳ„мһҘмЎ°мӮ¬ кІ°кіјм№ҳмҷҖ мҳҒмғҒмқ„ мқҙмҡ©н•ң м¶”м •м№ҳк°Җ лҶ’мқҖ мғҒкҙҖм„ұмқ„ ліҙмһ„м—җ л”°лқј м •нҷ•лҸ„лҘј лҶ’мқј мҲҳ мһҲлҠ” 분м„қ кё°мҲ мқ„ 추к°Җ м Ғмҡ©н•ңлӢӨл©ҙ, мӢӨм ң мӮ°лҰјмЎ°мӮ¬ нҳ„мһҘм—җ лҸ„мһ…н• мҲҳ мһҲмқ„ кІғмңјлЎң нҢҗлӢЁлҗңлӢӨ. лҳҗн•ң мқёкіөм§ҖлҠҘ кё°мҲ кіј лҚ”л¶Ҳм–ҙ кіөмӨ‘ LiDAR, м •л°Җмң„м„ұмҳҒмғҒ м •ліҙ мңөн•©мқ„ нҶөн•ҙ л”Ҙлҹ¬лӢқн•ҷмҠө л№…лҚ°мқҙн„°лҘј кө¬м¶•н•ңлӢӨл©ҙ, мӮ°лҰј мЎ°мӮ¬ л“ұм—җ мҶҢлӘЁлҗҳлҠ” мӢңк°„кіј 비мҡ©мқ„ нҡҚкё°м ҒмңјлЎң м Ҳм•Ҫн• мҲҳ мһҲлҠ” мІҙкі„к°Җ л§Ҳл Ёлҗ лҝҗл§Ң м•„лӢҲлқј мӮ°лҰј мқём ‘м§Җ мЈјліҖ м—°лЈҢкҙҖлҰ¬ м ңкұ°лӘ© м„ лі„, мӮ°лҰјкҙҖлҰ¬ мҡ°м„ мҲңмң„ лҢҖмғҒм§Җ м„ м • л“ұ мў…н•©м Ғмқё мӮ°л¶Ҳ м—°лЈҢкҙҖлҰ¬ мӢңмҠӨн…ң кө¬м¶•м—җ нҷңмҡ© к°ҖлҠҘн• кІғмңјлЎң кё°лҢҖлҗңлӢӨ.

References

1. Andersen, H.E, McGaughey, R, and Reutebuch, J (2004) Estimating forest canopy fuel parameters using LIDAR data. Remote sensing of Environment, Vol. 94, No. 4, pp. 441-449.

2. Carleer, A.P, Debeir, O, and Wolff, E (2005) Assessment of very high spatial resolution satellite image segmentations. Photogrammetric Engineering &Remote Sensing, Vol. 71, No. 11, pp. 1285-1294.

3. Chang, A.J, Yu, K.Y, Kim, Y.I, and Lee, B.K (2006) Estimation of individual tree and tree height using color aerial photograph and LiDAR data. Korean Journal of Remote Sensing, Vol. 22, No. 6, pp. 543-551.

4. Chen, Q, Baldocchi, D, Gong, P, and Kelly, M (2006) Isolating individual trees in a savanna woodland using small foot print lidar data. Photogrammetric Engineering &Remote Sensing, Vol. 72, pp. 923-932.

5. Cho, D.Y, and Kim, E.M (2010) Extraction of spatial information of tree using LIDAR data in urban area. Journal of the korean society for geospatial information system, Vol. 18, No. 4, pp. 11-20.

6. Cruz, M.G, Alexander, M.E, and Wakimoto, R.H (2002) Predicting crown fire behavior to support forest fire management decision-making. Forest Fire Research &Wildland Fire Safety, pp. 1-11.

7. Cruz, M.G, Alexander, M.E, and Wakimoto, R.H (2004) Modeling the likelihood of crown fire pccurrence in conifer forest stands. Forest Science, Vol. 50, No. 5, pp. 640-658.

8. Cruz, M.G, Alexander, M.E, and Wakimoto, R.H (2005) Development and testing of models for predicting crown fire rate of spread in conifer forest stands. Canadian Journal of Forest Research, Vol. 35, No. 7, pp. 1626-1639.

9. David, M (2010) The development and implementation of forest fire management decision support systems in otario, canada. Forestry&Natural-Resource Sciences, Vol. 3, No. 1, pp. 18-26.

10. Diaz-Varela, R, Rosa, R.D.L, Leon, L, Zarco-Tejada, P.J, and Pablo, J (2015) High-resolution airborne UAV imagery to assess olive tree crown parameters using 3D photo reconstruction:Application in breeding trials. Remote Sensing, Vol. 7, No. 4, pp. 4213-4232.

11. Diaz-Varela, R, Zarco-Tejada, P.J, Angileri, V, and Loudjani, P (2014) Automatic identification of agricultural terraces through object-oriented analysis of very high resolution dsms and multispectral imagery obtained from an unmanned aerial vehicle. Journal of Environmental Management, Vol. 134, pp. 117-126.

12. Dimitrios, P, Azadeh, A, Peter, S, and Vasco, C (2016) Determining tree height and crown diameter from high-resolution UAV imagery. International Journal of Remote sensing, Vol. 38, No. 8-10, pp. 2392-2410.

13. Edson, C, and Wing, M.G (2011) Airborne light detection and ranging (Lidar) for individual tree stem location, height, and biomass measurements. Remote Sensing, Vol. 3, No. 11, pp. 2494-2528.

14. Fritz, A, Kattenborn, T, and Koch, B (2013) UAV-based photogrammetric point cloudsвҖ”Tree stem mapping in open stands in comparison to terrestrial laser scanner point clouds. Remote Sensing &Spatial Information Sciences, Vol. 40, pp. 141-146.

15. Gini, R.D, Passoni, L.P, and Sona, G (2014) Use of unmanned aerial systems for multispectral survey and tree classification:A test in a park area of northern italy. European Journal of Remote Sensing, Vol. 47, No. 1, pp. 251-269.

16. Hussam, M, and Akshat, C (2018) Unraveling the complexity of wildland urban interface fires. Scientiflc, Vol. 8, No. 1, pp. 9315-9327.

17. Hyyppa, J, Schardt, M, Haggren, H, Koch, B, Lohr, U, Scherrer, H.U, et al (2001) The first european-wide attempt to derive sin gle-tree information from laser scanner data. Journal of Finland, Vol. 17, pp. 43-53.

18. James, M.R, and Robson, S (2012) Straight forward reconstruction of 3D surfaces and topography with a camera:Accuracy and geoscience application. Journal of Geophysical Research, Vol. 117, pp. 1-17.

19. Jan, D, Nagol, J, Hein, S, Thiel, C, and Reiner, Z (2017) Measurement of within-season tree height growth in a mixed forest stand using UAV imagery. Forests, Vol. 8, No. 231, pp. 1-15.

20. Kim, J.S, and Kwon, J.H (2020) Dron-based spectral library application study for species classification. Journal of the Korean Society of Surveting, Vol. 2020, No. 7, pp. 288-291.

21. Kim, S.Y (2015). A study on the analysis of fuel characteristics for forest fire hazard assessment. Ph.D. dissertation, Kongju National University.

22. Kim, S.Y, Jeong, J.H, Lee, S.J, and Kwon, C.G (2021) Estimating tree height and diameter at breast height using the unmanned aerial system for Korea pine (Pinus koraiensis) in Bonghwa region. Journal of Agriculture and Life Sciences, Vol. 55, No. 2, pp. 25-32.

23. Koji, S (1997) Analysis of the Relationship between dbh and crown projection area using a new model. Journal of Forest Research, Vol. 2, No. 4, pp. 237-242.

25. Korea Forest Service (KFS) (2016) Development of fuel model for the improvement of forest fire prevention system, pp. 264.

27. Kwak, D.A, Lee, W.K, Lee, J.H, Biging, G.S, and Gong, P (2007) Detection of individual trees and estimation of tree height using LiDAR data. Journal of Forest Research, Vol. 12, No. 6, pp. 425-434.

28. Lee, J.B, Heo, J, and Eo, Y.D (2007) Study on selection of optimized segmentation parameters and analysis of classification accuracy for object-oriented classfication. Korean Journal of Remote Sensing, Vol. 23, No. 6, pp. 521-528.

29. Lim, Y.S, Eo, Y.D, Jeon, M.C, Lee, M.H, and Pyeon, M.W (2016) Experiments of individual tree and crown width extraction by band combination using monthly drone images. Journal of the Korean Society for Geospatial Information Science, Vol. 24, No. 4, pp. 67-74.

30. Ota, T, Ogawa, M, Shimizu, K, Kajisa, T, Mizoue, N, Yoshida, S, et al (2015) Aboveground biomass estimation using structure from motion approach with aerial photographs in a seasonal tropical forest. Forests, Vol. 6, No. 11, pp. 3882-3898.

31. Pabi, O, Alvin, A.A, and Ofori, B.D (2020) Linking optical spot and unmanned aerial vehicle data for a rapid biomass estimation in a forest-savanna transitional zone of Ghana. West African Journal of Applied Ecology, Vol. 28, No. 1, pp. 1-19.

32. Paproki, A.X, Sirault, S, Scott, B, Furbank, R, and Fripp, J (2012) A novel mesh processing based technique for 3D plant analysis. BMC Plant Biology, Vol. 12, No. 1, pp. 63.

33. Park, J.G, and Jang, G.Y (2018) Investigation and analysis of forest geospatial information using drone. Journal of the Korea Academia-Industrial cooperation Society, Vol. 19, No. 2, pp. 602-607.

34. Song, C (2020). A study on the extraction of individual tree and tree height on thinning intensity using uav images. Master's thesis, Kongju National University.

35. Strigul, N (2012) Individual-based models and scaling methods for ecological forestry:Implications of tree phenotypic plasticity. Sustainable forest management, pp. 359-384.

- TOOLS

-

METRICS

-

- 1 Crossref

- 2,266 View

- 83 Download